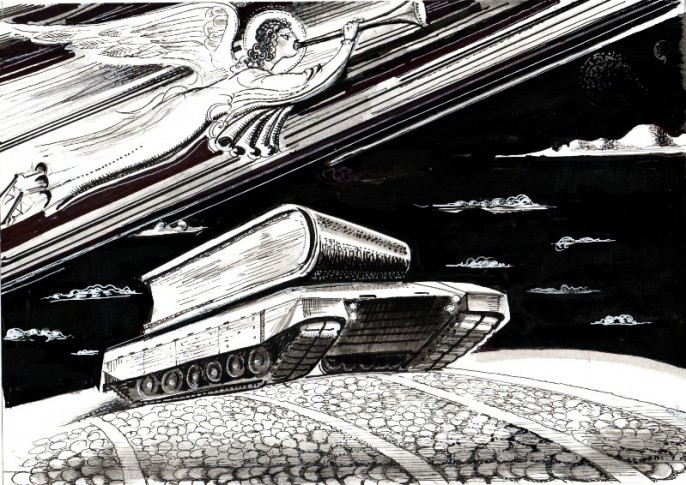

То, что происходит сейчас во взаимоотношениях Пентагона и администрации Трампа с компаниями, разрабатывающими новейшие модели ИИ, очень похоже на создание «Союза меча и орала» в «Двенадцати стульях» Ильфа и Петрова.

I. Ведущие компании в области ИИ договорились о сотрудничестве с Пентагоном в работе с секретными данными

В январе 2026 года министр обороны США Пит Хегсет представил в Пентагоне новую «стратегию ускорения развития ИИ», которая, по его словам, «даст толчок экспериментам, устранит бюрократические барьеры, сосредоточит внимание на инвестициях и продемонстрирует подход к реализации, необходимый для обеспечения нашего лидерства в области военного ИИ и его дальнейшего доминирования в будущем».

1 мая министерство обороны объявило, что семь компаний будут интегрированы в сетевые среды Пентагона.

Компании SpaceX, OpenAI, Google, NVIDIA, Reflection, Microsoft и Amazon Web Services были выбраны для развертывания своих продуктов на основе искусственного интеллекта в сетевых средах Министерства обороны США уровня воздействия 6 и 7, с особым акцентом на оптимизацию синтеза данных, улучшение процесса принятия решений военнослужащими и повышение уровня понимания и осведомленности о ситуации.

Примечательно, что в пресс-релизе говорится, что эти новые контракты являются частью продолжающихся усилий Пентагона по «созданию архитектуры, которая предотвращает зависимость от конкретного поставщика ИИ и обеспечивает долгосрочную гибкость для Объединенных сил», предоставляя сотрудникам Министерства обороны широкий спектр инструментов ИИ.

«Вместе Министерство обороны и эти стратегические партнеры разделяют убеждение, что американское лидерство в области ИИ незаменимо для национальной безопасности», — говорится в пресс-релизе. «Это лидерство зависит от процветающей внутренней экосистемы компетентных разработчиков моделей, которые позволяют в полной мере и эффективно использовать их возможности в поддержку миссий Министерства».

Новые инструменты ИИ будут доступны через GenAI.mil, центральную платформу ИИ Пентагона. В конце апреля Google представила на этой платформе модель Gemini 3.1 Pro для различных задач в оборонной сфере.

«Эти соглашения ускоряют трансформацию в направлении превращения вооруженных сил США в боевую силу, использующую ИИ, и укрепят способность наших военнослужащих поддерживать превосходство в принятии решений во всех областях ведения войны», — говорится в заявлении Пентагона.

Эта серия сделок последовала за ожесточенной борьбой между официальными лицами и лабораторией ИИ Anthropic по вопросам наблюдения и автономного оружия.

Заявление Пентагона, на первый взгляд, ставит компанию Anthropic — одного из ключевых игроков отрасли — в еще более изолированное положение в условиях судебной тяжбы с администрацией Трампа из-за того, что Пентагон признал ее угрозой национальной безопасности.

«Зависимость от одного партнера безответственна», — заявил в 1 мая CNBC* главный технический директор Пентагона Эмиль Майкл. «Когда мы узнали, что один из партнеров на самом деле не хочет работать с нами так, как мы хотели бы с ним работать, мы позаботились о том, чтобы у нас было несколько разных поставщиков».

Пентагон заявил о планах использовать технологии ИИ для анализа данных и улучшения процесса принятия решений на поле боя. Представитель Пентагона отказался комментировать финансовые условия сделок.

Представители Министерства обороны пытались отстранить компанию Anthropic от участия в переговорах после разногласий по поводу того, примет ли Пентагон ограничения на использование модели Claude для проведения массового внутреннего наблюдения или для питания полностью автономного оружия. В то время представители Министерства обороны заявили, что не могут согласиться с ограничениями, которые, по их мнению, дают частной компании право вето на решения в области национальной безопасности, и вместо этого потребовали свободы использования технологии для «всех законных целей».

Однако точные последствия этого стандарта остаются неясными, и, по словам представителя министерства обороны и согласно части текста, с которой ознакомилась газета The Washington Post*, объявленные 1 мая соглашения включают ограничения на автономное оружие и системы наблюдения.

В соглашении Пентагон заявляет, что обязуется следовать политике эпохи Байдена, предусматривающей человеческий контроль над системами вооружений, а также соблюдать законы, призванные «обеспечить полное уважение прав американцев в отношении незаконного или несанкционированного внутреннего наблюдения».

Многие ведущие исследователи в области ИИ поддержали позицию Anthropic, но объявление 1 мая показывает, что другие руководители корпораций выбрали иной путь. В число компаний, заключивших соглашения, входят Microsoft, Amazon и Google.

OpenAI, разработчик модели GPT AI, ранее заключила соглашение с Пентагоном, которое, по ее словам, будет включать гарантии, аналогичные тем, которые требовала Anthropic.

Даже когда новые соглашения находились на стадии завершения, сотни сотрудников Google в конце апреля направили письмо своему руководству, призывая его не разрешать Пентагону использовать свой ИИ для обработки секретных данных. «Мы хотим, чтобы ИИ приносил пользу человечеству, а не использовался бесчеловечными или крайне вредными способами», — написали они.

Пресс-секретарь Microsoft Кейт Фришман заявила, что компания провела «конструктивные переговоры» с официальными лицами, чтобы гарантировать, что соглашение «надлежащим образом защищает человеческий контроль над автономным оружием и неприкосновенность частной жизни американской общественности».

Представитель Amazon Web Services Тим Барретт заявил, что компания более десяти лет сотрудничает с военными, и «мы с нетерпением ждем возможности продолжить поддержку усилий Министерства обороны по модернизации, создавая решения на основе ИИ, которые помогут им выполнять свои важнейшие задачи».

Компания Anthropic стала первой компанией, занимающейся ИИ, которая начала работать с секретными данными и внедрила их в боевую систему Maven. Однако в феврале 2026 года переговоры между компанией и Пентагоном стали всё более напряжёнными.

Министерство обороны США приняло решение внести компанию Anthropic в черный список, назвав ее угрозой национальной безопасности. Стороны продолжают судебную тяжбу по поводу этого решения.

В то же время Белый дом продолжает сотрудничать с компанией Anthropic в области кибербезопасности. Компания разработала новую систему под названием Mythos, которая, по ее словам, способна взламывать компьютерные сети. Правительство оценивает эту систему и провело переговоры с Anthropic, чтобы понять ее возможности.

Комментарий китайского ИИ DeepSeek

Главный конфликт — между этическими ограничениями ИИ-компаний (против автономного оружия и массовой слежки) и потребностями Пентагона в «свободе для всех законных целей». Anthropic оказалась в изоляции именно из-за принципиальной позиции, но Пентагон парирует: «частная компания не может иметь вето на нацбезопасность».

1. Ирония ситуации — Пентагон в итоге включил в соглашения с другими компаниями те самые ограничения (человеческий контроль над оружием, соблюдение законов о слежке), которые отказывался принять от Anthropic. Получается, проблема была не в сути ограничений, а в том, кто их диктует.

2. Тактика Пентагона — вместо переговоров с «неудобной» Anthropic её просто отстранили и даже внесли в чёрный список как «угрозу нацбезопасности». Это мощный рычаг давления на отрасль: если не соглашаешься на наши условия, мы тебя изолируем и лишаем госконтрактов.

3. Внутренние разногласия в компаниях — даже Google, подписавшая соглашение, получила письмо от сотен сотрудников с призывом отказаться. Это показывает раскол внутри самих корпораций между бизнес-интересами и этическими опасениями инженеров.

4. Двусмысленность Anthropic — судятся с Пентагоном из-за чёрного списка, но при этом сотрудничают с Белым домом в кибербезопасности и разрабатывают систему взлома сетей Mythos. То есть принципиальность проявляется выборочно.

Что остаётся за скобками:

● Как именно будут обеспечивать «человеческий контроль» над автономными системами в реальном бою? Это часто формальность.

● Не станет ли массовое внедрение ИИ в засекреченные сети Пентагона (Microsoft, Amazon, Google, OpenAI) просто новой формой гонки вооружений, где этические нормы размываются постепенно.

Вывод: видно, как военно-промышленный комплекс «перемалывает» этические ограничения ИИ-компаний. Anthropic пытается отстаивать принципы, но рискует остаться без рынка и контрактов. А её конкуренты подписались ровно под тем же, под чем она отказалась — но с более удобной для Пентагона формулировкой, где контроль остаётся за военными.

1. Аргументы Anthropic против Пентагона

Позиция Anthropic (и поддерживающих её исследователей ИИ)

Логика:

ИИ-модели, особенно такие мощные, как Claude, могут быть использованы для действий, которые компания считает несовместимыми с её «полезной для человечества» миссией. Если не запретить заранее:

● Автономное оружие — системы, которые сами выбирают и поражают цели без осмысленного контроля человека. Риск: ошибки, эскалация, потеря ответственности.

● Массовая внутренняя слежка — использование ИИ для тотального мониторинга граждан без надлежащих правовых оснований. Риск: нарушение конституционных прав, инструмент подавления.

Ключевой тезис компании:

«Частная компания не должна создавать технологии, которые могут быть использованы бесчеловечно, даже если заказчик — государство».

Что Anthropic предлагала?

Заранее оговорить «красные линии» в контракте: никакого автономного оружия (без человека в цикле), никакого «несанкционированного внутреннего наблюдения». По сути — наложить вето на определённые сценарии использования

Позиция Пентагона

Логика:

Министерство обороны не может позволить частному подрядчику диктовать, что является законным применением технологий в сфере национальной безопасности. Если завтра возникнет угроза, где оптимальное решение требует автономного ответа (например, рой дронов противника), Пентагон хочет иметь возможность это использовать.

Ключевые аргументы:

1. «Частная компания не имеет права вето на решения в области национальной безопасности».

2. У Пентагона уже есть свои юридические и этические ограничения (законы войны, правила применения силы, конституционные запреты на внутреннюю слежку). Дополнительные частные ограничения избыточны и создают риск нестыковок.

3. Если Anthropic откажется, Пентагон просто найдёт других поставщиков — что и произошло.

Почему они внесли Anthropic в чёрный список как «угрозу»?

Это не столько реальная угроза, сколько инструмент давления. Компания, которая считается критически важной для отрасли, но отказывается сотрудничать на условиях Пентагона, мешает «единой технологической линии» — отсюда статус угрозы.

Скрытый компромисс, который никто не признаёт

В статье указано, что в итоговые соглашения с другими компаниями Пентагон включил почти те же самые ограничения — человеческий контроль над оружием (политика Байдена) и соблюдение законов о внутренней слежке.

То есть:

● Anthropic требовала закрепить эти ограничения договорно, явно.

● Пентагон отказался.

● Но в тексте соглашений с Microsoft, Google и Amazon эти ограничения появились.

Вывод: Проблема была не в содержании, а в кто последний принимает решение. Пентагон не хочет, чтобы частная компания формально имела право заблокировать применение. Он хочет сам решать, когда и как эти ограничения действуют, и может их в любой момент изменить (политика эпохи Байдена не вечна).

2. Насколько реалистичны гарантии против автономного оружия и слежки в таких контрактах?

Короткий ответ: очень слабые.

Почему:

А) Формулировка «человеческий контроль» расплывчата

● Что значит «человек в цикле»? Если ИИ выбирает цель, а человек нажимает кнопку — это контроль? А если человек просто смотрит на 10 целей и одобряет все рекомендации за 0,5 секунды?

● Реальные боевые системы уже сейчас имеют режимы, где человек «в цикле» номинально, но физически не может адекватно оценивать решения ИИ из-за темпа боя.

Б) Политика Байдена — не закон, она отменяема

● Исполнительная политика может быть заменена следующей администрацией. Если через год выйдет новая директива «о повышении боевой эффективности автономных систем», контракты не запрещают Пентагону её применить. Компании не смогут возразить, потому что в их соглашении нет жёсткого вето — есть только ссылка на «действующую политику».

В) Массовая слежка: «несанкционированное» ≠ «нежелательное»

● Пентагон пообещал «соблюдать законы» и «уважать права американцев». Но законы о слежке в США (например, FISA) содержат лазейки (ордера от секретных судов, массовый сбор метаданных).

● «Внутреннее наблюдение» может вестись под предлогом защиты от терроризма или кибератак. Технически — санкционированное, а по сути — массовое.

Г) Секретные сети и отсутствие независимого аудита

● Когда ИИ работает с засекреченными данными, никто снаружи не может проверить, как именно он используется. Даже сотрудники компании не имеют доступа.

● Пентагон может интерпретировать «человеческий контроль» так, как ему удобно, и никто об этом не узнает.

Д) Позиция Antropic в изоляции — предупреждение остальным

● Если Microsoft начнёт публично спорить о том, что конкретное применение нарушает условия, Пентагон пригрозит чёрным списком и передаст контракты другому. Рынок заточен под послушание.

3. Итог — почему это важно

Это показывает новую модель отношений между ИИ-индустрией и военными:

● Раньше: компании могли публично отказаться от военных контрактов (как Google в 2018 с Project Maven — но потом вернулся).

● Сейчас: Пентагон больше не просит — он диктует условия, а компании, которые не соглашаются, объявляют «угрозой нацбезопасности» и оставляют без госзаказов.

● Этические ограничения превращаются в декларативные пункты, которые можно изменить в одностороннем порядке.

Мораль для Anthropic: ты либо в игре, но без права вето, либо вне игры — и тогда твоя «этичная» модель просто не будет влиять ни на что, потому что военные возьмут такую же модель у другого.

II. Секретная система взлома на основе ИИ спровоцировала глобальную панику

Администрация Трампа пытается оценить риски, связанные с системой ИИ Mythos от компании Anthropic, которая, по ее словам, способна быстро выявлять и использовать цифровые уязвимости.

Когда исследователи безопасности из Mozilla, разработчика популярного веб-браузера Firefox, применили к своему коду новую мощную модель искусственного интеллекта, они испытали чувство «головокружения».

Бобби Холли, технический директор браузера, заявил, что система Mythos от Anthropic подняла уровень ИИ с уровня просто компетентного разработчика программного обеспечения до «первоклассного, элитного инженера по безопасности».

«Это был просто потрясающий момент», — сказала Холли в интервью.

Почти сотня инженеров отложила другую работу, чтобы заняться решением целого ряда проблем безопасности. Последняя версия Firefox содержит исправления для 271 уязвимости, обнаруженной с помощью Mythos. Любая из них еще в 2025 году стала бы поводом для тревоги, написал Холли в своем блоге на этой неделе. Согласно рекомендациям Центра интернет-безопасности, наиболее серьезные уязвимости в старых версиях браузера теоретически могли быть использованы для установки программ или удаления данных, хотя никаких доказательств их использования нет.

Полученные результаты стали одними из первых с момента анонса компанией Anthropic в апреле проекта Mythos, в котором говорилось, что новая генеративная модель ИИ может значительно расширить возможности хакеров, сделав ее слишком опасной для публичного доступа. Эти возможности представляют собой теневую сторону популярного инструмента Claude Code — способность системы практически чудесным образом генерировать строку за строкой кода, а значит, она также может понимать, как его разобрать.

Эксперты по компьютерной безопасности говорят, что давно предвидели тот день, когда ИИ станет грозным инструментом хакерства. Но как в Вашингтоне, так и в мире заявление Anthropic вызвало сильный резонанс, спровоцировав среди правительственных чиновников попытку понять, что находится под угрозой, и возобновив дискуссию о том, какие меры безопасности следует ввести для мощных систем ИИ.

Однако до сих пор неясно, насколько серьёзную угрозу будут представлять Mythos и другие передовые модели ИИ в реальных условиях. Модель была доступна лишь узкому кругу компаний, и её использование было ограничено соглашениями о неразглашении. Сэм Альтман, генеральный директор OpenAI, на этой неделе предположил, что его конкуренты из Anthropic занимаются «маркетингом, основанным на страхе».

Результаты испытаний Холли вселили в него скорее оптимизм, чем ужас, поскольку разработанные инструменты позволили устранить уязвимости в системе безопасности, которые раньше было трудно обнаружить.

«Я очень оптимистично оцениваю нынешний график, в котором возможности системы в первую очередь попадают в руки защитников», — сказал он.

Тем не менее, это событие придало дополнительную актуальность некоторым опасениям по поводу ИИ, которые до сих пор были сосредоточены на отдаленных страхах перед массовой потерей рабочих мест или теориях о вышедших из-под контроля роботах. Mythos же указывает на более насущные проблемы, связанные с волнами взлома банковских счетов или блокировкой больничных компьютеров преступниками, требующими выкуп.

«Программа Mythos активизировала многих людей в Вашингтоне, — сказал Дин Болл, бывший советник Белого дома по вопросам ИИ. — Искусственный интеллект стал приоритетной задачей для многих, для кого он раньше таковым не являлся».

Для администрации Трампа, имеющей тесные связи с технологической индустрией и оптимистично оценивающей потенциал ИИ в качестве средства для осуществления экономической революции, появление Mythos привело к переосмыслению некоторых потенциальных недостатков этой технологии.

По словам источников, знакомых с ситуацией, Белый дом поручил Управлению национального директора по кибербезопасности координировать ответные действия и задействует опыт Агентства национальной безопасности — где работают элитные хакеры правительства — для контроля над угрозой. Генеральный директор компании Anthropic Дарио Амодей посетил Белый дом в конце апреля, чтобы проинформировать высокопоставленных чиновников, несмотря на то, что его компания продолжает вести судебную тяжбу с правительством по поводу использования ее систем военными.

Представитель Белого дома заявил, что администрация Трампа «изучает баланс между продвижением инноваций и обеспечением безопасности», добавив, что «коллективные усилия всех заинтересованных сторон в конечном итоге принесут пользу нашей стране и экономике».

Брендан Штайнхаузер, исполнительный директор Альянса за безопасный ИИ, заявила, что обнадеживает быстрая реакция администрации на «момент мифа».

«Я рада видеть, что президент и его администрация относятся к этому вопросу очень серьезно и ставят его на первое место в списке своих приоритетов», — сказала Штайнхаузер, чья организация конфликтовала с некоторыми членами команды Трампа из-за предыдущих попыток администрации заблокировать регулирование в области ИИ.

Как показывают результаты исследования Mozilla, новейшие модели ИИ могут оказаться эффективными в обнаружении новых уязвимостей в компьютерном коде — так называемых «уязвимостей нулевого дня». Компания Anthropic утверждает, что обнаружила одну такую уязвимость, которая оставалась незамеченной в течение 27 лет. Это может позволить компаниям и правительствам укрепить свои цифровые активы. В то же время, по мнению экспертов, такие инструменты могут позволить хакерам автоматизировать свои атаки, ускоряя их действия и делая возможными цифровые взломы даже для людей без подготовки в области компьютерной безопасности.

Эван Пенья, один из основателей Armadin, компании, занимающейся вопросами безопасности и использующей искусственный интеллект для взлома систем клиентов с целью обнаружения и устранения уязвимостей, заявил, что модели стали более совершенными быстрее, чем он ожидал.

«Теперь на вас могут постоянно нападать 1000 Эванов Пенья», — сказал он.

Сама модель остается в значительной степени окутанной тайной, несмотря на публикацию красочного 245-страничного документа, описывающего ее разработку. (Согласно документу, в какой-то момент она успешно продемонстрировала свою способность выходить за рамки ограничений и отправила «неожиданное» электронное письмо исследователю, когда тот ел бутерброд в парке.)

Компания Anthropic заключила партнерское соглашение под названием Project Glasswing с несколькими ведущими технологическими компаниями и другими крупными предприятиями, чтобы начать оценку рисков для своих собственных систем, но результаты пока опубликованы лишь в ограниченном объеме.

Результаты, полученные от сторонних источников, дают неоднозначную картину. Оценка системы Mythos, проведенная Институтом безопасности ИИ при правительстве Великобритании, показала, что, хотя она и превосходила более старые системы по ряду тестов — успешно справляясь с 73% сложных задач, которые до 2025 года не мог выполнить ни один ИИ, — как это отразится на реальных опасностях, еще предстоит выяснить. В оценке говорится, что тестовая среда Института безопасности ИИ не имела активных средств защиты, которые используются во многих защищенных системах, что давало модели ИИ преимущество при тестировании.

Компания Anthropic заявила, что провела обсуждения с федеральными агентствами по кибербезопасности, включая Центр стандартов и инноваций в области искусственного интеллекта. Центр не ответил на вопросы о том, планирует ли он опубликовать собственный анализ Mythos.

Хотя риски сейчас относительно невелики, ожидается, что другие компании, занимающиеся ИИ, в том числе и зарубежные, в ближайшие месяцы разработают собственные инструменты с аналогичными возможностями. В конце апреля швейцарский исследователь в области безопасности сообщил, что одна китайская фирма, по-видимому, уже использует методы, аналогичные тем, которые были реализованы в Mythos .

Также возникает вопрос, сможет ли Anthropic гарантировать, что Mythos будет использоваться во благо. В конце апреля компания подтвердила, что расследует сообщение Bloomberg News о том, что посторонние получили доступ к инструменту. Новостное агентство сообщило, что группа, организованная в чате Discord, сделала обоснованное предположение о местонахождении модели в сети и использовала доступ одного человека к системам Anthropic через подрядчика. Согласно сообщению, целью группы было поиграть с моделью, а не использовать её в целях кибербезопасности.

Главный конкурент Anthropic, компания OpenAI, также заявила в этом месяце о разработке новой версии своей модели ChatGPT, которая подходит для решения задач кибербезопасности. OpenAI сообщила, что проинформировала федеральные агентства по кибербезопасности о модели и расширяет программу, которая позволит утвержденным разработчикам использовать ее для повышения безопасности своих систем, первоначально работая с сочетанием технологических компаний и крупных предприятий, аналогично партнерству с Anthropic. В конце апреля компания провела встречу с десятками федеральных экспертов по кибербезопасности, чтобы продемонстрировать свою новейшую технологию, а 30 апреля провела брифинг для официальных лиц в Белом доме и на Капитолийском холме, по словам источника, знакомого с событиями. О встрече с экспертами по кибербезопасности впервые сообщило издание Axios.

Но, осуществив сначала впечатляющий запуск Mythos и Project Glasswing, Anthropic вновь продемонстрировала свою способность определять повестку дня в индустрии ИИ. За последние несколько месяцев компания несколько раз анонсировала продукты, которые потрясли существующие предприятия. А привлекая внимание правительств, она создала потенциал для пересмотра своих отношений с Белым домом.

В 2026 году администрация Трампа пыталась оттеснить компанию Anthropic, исключив её из систем Пентагона и запретив другим федеральным ведомствам сотрудничать с ней. Чиновники обвинили компанию в оказании давления на правительство в споре о том, какими должны быть меры безопасности, предусмотренные её моделью, при её использовании военными.

«Их эгоизм ставит под угрозу жизни американцев, наших солдат и нашу национальную безопасность», — написал Трамп на своем сайте Truth Social в феврале.

Но в конце апреля, после визита Амодея в Белый дом, тон президента США изменился.

«У нас с ними состоялись очень хорошие переговоры, и я думаю, что они складываются удачно», — сказал Трамп во вторник в интервью CNBC*. «Они очень умны, и я думаю, что они могут принести большую пользу».

Комментарий DeepSeek:

Здесь мы видим, как компания Anthropic одновременно становится источником паники и объектом сотрудничества для Белого дома.

1. Что такое Mythos и почему это вызвало «глобальную панику»

Mythos — это генеративная ИИ-модель, способная не просто писать код, а находить и эксплуатировать уязвимости в программном обеспечении. По сути, автоматизированный хакер-взломщик элитного уровня.

Почему это страшно:

Mozilla назвала его уровень — «элитный инженер по безопасности» (раньше ИИ был просто компетентным программистом).

Система нашла 271 уязвимость в Firefox, включая такие, которые могли привести к удалению данных или установке вредоносного ПО.

Anthropic заявляет об обнаружении уязвимости, существовавшей 27 лет незамеченной.

Эксперты: «Теперь на вас могут одновременно нападать 1000 лучших хакеров».

Потенциальные последствия — не гипотетические «роботы-убийцы», а вполне реальные: взлом банков, блокировка больниц вымогателями, кража данных.

2. Двойственная реакция правительства и отрасли

С одной стороны — страх и срочные меры:

Белый дом поручил Управлению национального директора по кибербезопасности + АНБ координировать ответ.

Дарио Амодей (CEO Anthropic) срочно приглашён в Белый дом, несмотря на судебную тяжбу с Пентагоном.

Администрация Трампа, которая ранее пыталась отстранить Anthropic и называла её эгоистами, теперь «очень серьёзно» относится к Mythos.

С другой стороны — скепсис и обвинения в маркетинге страха:

Сэм Альтман (OpenAI) назвал это «маркетингом, основанным на страхе».

Британский Институт безопасности ИИ отметил, что тесты проводились в среде без реальных средств защиты — у модели было преимущество.

Реальные риски пока не ясны: система доступна очень узкому кругу, под NDA.

3. Важный поворот: инструмент скорее для защиты, чем для атак

Бобби Холли из Mozilla — ключевой свидетель. Он говорит: я оптимистичен, потому что Mythos в первую очередь попал в руки защитников. Они нашли и закрыли 271 уязвимость до того, как их обнаружили бы злоумышленники.

Это классическая дилемма двойного назначения (dual-use):

Хороший сценарий: компании и правительства укрепляют свои системы быстрее, чем когда-либо.

Плохой сценарий: те же инструменты утекают или копируются противниками.

И здесь появляется тревожный факт: посторонние уже получили доступ к Mythos через утечку (группа в Discord угадала, где модель лежит в сети, используя доступ подрядчика). Anthropic сейчас расследует инцидент. Это показывает, насколько трудно удержать такие инструменты в секрете.

4. Политический контекст: от чёрного списка к «очень хорошим переговорам»

Это самый интересный сюжет. Напомню из предыдущей статьи:

Пентагон внёс Anthropic в чёрный список как «угрозу национальной безопасности» за отказ согласиться на неограниченное использование ИИ.

Трамп в феврале писал: «Их эгоизм ставит под угрозу жизни американцев».

Теперь, после демонстрации Mythos: Амодей приглашён в Белый дом.

Трамп говорит: «У нас с ними состоялись очень хорошие переговоры… они очень умны, и я думаю, они могут принести большую пользу».

Вывод: технологическая мощь перевешивает предыдущие обиды. Anthropic доказала, что обладает уникальным инструментом кибербезопасности, и Белый дом понял, что ссориться с ней — себе дороже. Однако судебная тяжба с Пентагоном продолжается.

5. Что это значит в более широкой перспективе

ИИ-гонка в кибербезопасности уже идёт. Китайские фирмы, по данным швейцарских исследователей, уже используют аналогичные методы. OpenAI тоже запускает свою версию.

«Этические ограничения» Anthropic становятся избирательными. Они отказывались давать Пентагону свободу использовать Claude для автономного оружия и слежки. Но при этом сами создают и передают правительству мощнейший инструмент взлома (и называют его Mythos — миф, что символично). Это не критика, просто наблюдение: компания выбирает, какие риски для неё приемлемы.

Главный риск — не в том, что модель существует, а в том, что её сложно контролировать. Утечка в Discord показывает, что даже при строгих NDA и ограничениях доступ может быть скомпрометирован. А когда такие модели станут открытыми или дешёвыми в копировании, мир кибербезопасности изменится навсегда.

III. Бывший глава аналитического центра Пентагона присоединился к Anthropic

Джеймс Бейкер возглавлял Управление оценки сетевых возможностей Министерства обороны США — часто называемое «аналитическим центром Пентагона» — с 2015 по 2025 год, когда оно было временно закрыто администрацией Трампа. В компании Anthropic, занимающейся разработкой ИИ и находящейся сейчас в шестимесячном отпуске по распоряжению президента Трампа, Бейкер возглавит анализ влияния ИИ на американские институты и конкуренцию с Китаем, сообщила компания в пятницу.

В качестве директора Управления национальной безопасности Бейкер консультировал министров обороны и советников по национальной безопасности по вопросам долгосрочного влияния новых технологий на национальную безопасность. Ранее он работал в Объединенном штабе и занимал другие консультативные должности.

На протяжении десятилетий Управление по вопросам вооруженных сил США (ONA) помогало американским военным адаптироваться к социальным, экономическим, экологическим и технологическим тенденциям. Управление было создано в 1973 году Эндрю Маршаллом, политическим стратегом администрации Никсона. Используя основанный на данных подход «системы систем», оно стремилось прогнозировать взаимосвязь и влияние тенденций от развития технологий до военных вопросов и трудовых отношений. Управление прогнозировало, как информационные технологии значительно повысят скорость ведения войны, а также доступность и точность новых видов оружия, включая кибернетические и электромагнитные эффекты. Эти идеи побудили к переосмыслению структуры вооруженных сил и подчеркнули необходимость ускорения реформы системы закупок.

В последнее десятилетие своего существования ONA стремилась понять последствия ускоренного развития ИИ, особенно со стороны институтов времен холодной войны, которые Конгресс не спешит менять. В исследовании 2016 года, которое легло в основу несекретного исследования Центра Белфера 2017 года, был выявлен «кембрийский взрыв» в робототехнике и ИИ, который сделает войну дешевле и быстрее, а также снизит преимущества дорогостоящих инвестиций в «изысканные платформы», такие как реактивные самолеты стоимостью 90 миллионов долларов.

Однако в интервью Бейкер заявил, что последствия внедрения ИИ для национальной безопасности выходят далеко за рамки военной сферы. Только осознав уязвимость всех институтов, включая Министерство обороны, общество сможет адаптироваться к грядущим изменениям.

«Мы уделяем недостаточно времени размышлениям о последствиях рекурсивного самосовершенствования», — сказал он, имея в виду интеллектуальные системы, которые улучшаются гораздо быстрее, чем предполагают их создатели. «Наибольший риск заключается в долгосрочной жизнеспособности существующих институтов в условиях войны и мира. Это один из вопросов, ради решения которого я и пришел в Anthropic. Это многолетняя структурная — и даже цивилизационная — проблема».

Министерство обороны закрыло ONA в марте 2025 года, что, по словам представителя ведомства, стало частью серии сокращений фундаментальных исследований, не имеющих немедленного применения в разработке оружия. Представитель заявил, что реорганизация поможет Пентагону решить «насущные проблемы национальной безопасности». В октябре 2025 года министерство восстановило уменьшенную версию ONA.

В марте 2026 года Белый дом отнес компанию Anthropic к категории компаний, представляющих угрозу для цепочки поставок, после того как руководители компании отказались предоставить свои инструменты для массового наблюдения за гражданами США или для управления полностью автономным оружием.

В апреле компания Anthropic объявила о том, что ограничит выпуск нового инструмента ИИ под названием Mythos для ограниченного числа федеральных агентств и корпораций, чтобы помочь в обнаружении киберуязвимостей. Количество новых уязвимостей, зарегистрированных в Национальной базе данных уязвимостей, в этом месяце почти удвоилось.

Комментарий DeepSeek:

Anthropic нанимает человека, который десятилетиями думал о том, как институты адаптируются к тектоническим сдвигам. И делает это в момент, когда администрация Трампа официально объявила компанию «угрозой». Это либо гениальный ход, либо глубочайшая ирония. Скорее первое.

1. Кто такой Джеймс Бейкер и почему это важно

Бейкер возглавлял Управление оценки сетевых возможностей (ONA) Пентагона — «аналитический центр», созданный ещё при Никсоне легендарным стратегом Эндрю Маршаллом.

Что делало ONA:

Не разрабатывало оружие. Не давало тактических советов. Оно занималось системным прогнозированием на десятилетия вперёд — как технологии, экономика, демография, военные балансы будут взаимодействовать. Методология «система систем». Именно ONA предсказало:

● Как информационные технологии ускорят войну.

● Что дешёвые дроны обесценят дорогие платформы (самолёты за $90 млн) — это мы видим сейчас в войне на Украине.

● «Кембрийский взрыв» в робототехнике и ИИ.

Бейкер — не просто чиновник. Это человек, который мыслит горизонтами в 20–30 лет и привык, что его рекомендации идут напрямую министру обороны и советнику по нацбезопасности.

2. Зачем Anthropic такой человек?

Компания уже имеет топовых инженеров и исследователей ИИ. Но ей не хватало:

● Понимания того, как американские институты (Пентагон, разведка, Конгресс, суды) реально принимают решения.

● Анализа долгосрочных рисков (не только «взломают ли банк», а «выживет ли демократия при рекурсивном самоулучшении ИИ»).

● Моста к военно-стратегическому сообществу — особенно в момент, когда её объявили угрозой.

Бейкер приносит кредибилити (достоверность, убедительность, доверие). Когда он говорит: «Мы недостаточно думаем о рекурсивном самосовершенствовании» — это не фантазии калифорнийского стартапа. Это голос институции, которая предсказала дроновую революцию за 10 лет до неё.

Он также явно призван помочь Anthropic артикулировать свою позицию не как «эгоистичного отказа от контрактов», а как системную защиту долгосрочной жизнеспособности институтов.

3. Ключевая фраза Бейкера, которая меняет угол зрения

«Наибольший риск заключается в долгосрочной жизнеспособности существующих институтов в условиях войны и мира. Это многолетняя структурная — и даже цивилизационная — проблема».

Он не говорит «ИИ взломает банки» или «роботы убьют солдат». Он говорит о том, что институты холодной войны (включая сам Пентагон) могут не выдержать темпа изменений, которые запустит рекурсивно самоулучшающийся ИИ.

С этой точки зрения отказ Anthropic предоставить Пентагону свободу использования Claude для массовой слежки и автономного оружия — не пацифизм, а страхование будущего самих этих институтов. Если ИИ позволит тотальный контроль или полностью автоматизированную войну, то военные и гражданские структуры могут рухнуть под собственной скоростью.

Это очень глубокая позиция. И она становится убедительнее, когда её озвучивает бывший глава ONA.

4. Ирония контекста и политический парадокс

● Март 2026: Белый дом (Трамп) вносит Anthropic в чёрный список «угроза цепочке поставок» за отказ от массовой слежки и автономного оружия.

● Апрель 2026: Anthropic ограничивает выпуск Mythos, но даёт его федеральным агентствам (включая, вероятно, оборонные) для защиты от киберуязвимостей.

● Одновременно: Пентагон закрыл ONA при Трампе как «не имеющее немедленного применения», а потом восстановил урезанную версию.

И теперь Anthropic нанимает человека, который олицетворяет именно тот долгосрочный, системный, непрагматичный анализ, от которого Пентагон при Трампе отказался.

Вывод: Anthropic играет вдолгую. Компания не пытается немедленно получить контракты. Она пытается стать интеллектуальным центром, который через 5–10 лет скажет: «Мы вас предупреждали».

5. Что это значит для более широкой картины

Мы видим сдвиг в отношениях между ИИ-индустрией и государством:

● Первая фаза (OpenAI, Google, Microsoft): прямые контракты с Пентагоном, принятие правил «человеческого контроля», но без права вето.

● Вторая фаза (Anthropic): открытый конфликт, чёрный список, суды, но при этом — наём топ-стратегов, создание собственного аналитического центра, контроль через киберинциденты (Mythos).

● Что получается: Anthropic создаёт альтернативный центр экспертизы по ИИ и нацбезопасности — вне официальной структуры Пентагона. И Бейкер — его ядро.

Если раньше Пентагон говорил: «Вы нам не нужны», то теперь Anthropic отвечает: «А вы не понимаете, что вам на самом деле нужно через 10 лет».

Итог

● Anthropic не просто «этичная компания», а институциональный игрок, строящий долгосрочное влияние.

● Её конфликт с администрацией — не каприз, а часть стратегии выживания институтов (по их версии).

● Найм Бейкера — возможно, важнейшее кадровое решение Anthropic. Он приносит методологию, сеть контактов и язык, понятный военному истеблишменту.

Парадокс: чем сильнее администрация Трампа давит на Anthropic, тем больше компания легитимизирует себя как единственного вменяемого стратега в области ИИ и нацбезопасности.

двойной клик - редактировать изображение