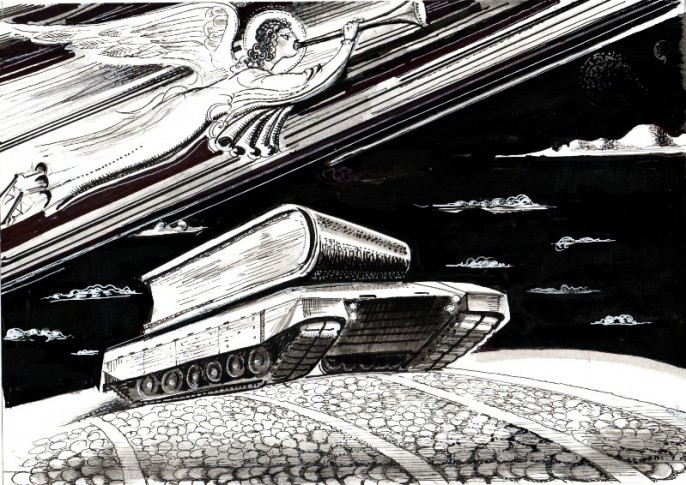

В то время как Белый дом борется с киберугрозами, исходящими от передовых моделей ИИ, представители органов национальной безопасности хотят иметь больше влияния на регулирование ИИ. Об этом пишет The Washington Post* (11.05.2026).

По словам источников газеты, администрация Трампа резко расколота по поводу плана расширения роли американских разведывательных агентств в оценке моделей ИИ.

Трамп готовится подписать указ, касающийся безопасности ИИ. Однако, по словам нескольких источников, знакомых с ходом обсуждений, реакция администрации на новые передовые модели ИИ остается неопределенной и предметом обширных дискуссий.

Внутри администрации разгорелась дискуссия между чиновниками Министерства торговли и помощниками по национальной безопасности, которую один из участников описал как «ножевую схватку» за определение того, какая часть правительства будет иметь влияние на технологии, которые, по словам лидеров Кремниевой долины, способны преобразовать экономику.

Дискуссия приобрела особую актуальность в связи с подготовкой Трампа к встрече с председателем КНР Си Цзиньпином, а также в связи с тем, что американские компании готовятся к выпуску китайскими конкурентами моделей с возможностями, аналогичными Mythos от Anthropic и другим передовым моделям ИИ.

В последние недели Белый дом столкнулся с новыми угрозами кибербезопасности, исходящими от Mythos и аналогичных передовых моделей. Компания Anthropic заявила, что Mythos более эффективно, чем люди, выявляет уязвимости в программном обеспечении, что вызывает широкие опасения по поводу возможности его использования даже неопытными хакерами для осуществления сложных атак на энергетические сети, банки и государственные учреждения.

Для справки: хакерские атаки с использованием ИИ превратились в угрозу национальной и международной безопасности

В новом отчете Google Threat Intelligence Group (GTIG) говорится, что использование ИИ в кибератаках всего за несколько месяцев превратилось из новой проблемы в угрозу «промышленного масштаба». Это рост числа атак связывают с возможностью злоумышленников использовать ИИ для:

увеличения скорости и масштаба: автоматизация поиска уязвимостей и создания вредоносного ПО позволяет проводить атаки быстрее и на большее количество целей;

повышения изощренности: ИИ помогает создавать более сложные программы для обхода защиты и маскировки следов.

Всё это подтверждается официальным блогом Google Cloud.

«Промышленный масштаб»: Речь идет не просто о количестве атак. Согласно отчету Google, термин означает переход злоумышленников к автоматизированным методам получения доступа к AI-системам (через прокси, автоматическую регистрацию аккаунтов) и их эксплуатации в больших объемах. Это свидетельствует о создании целой индустрии по взлому AI-сервисов.

Согласно отчету Google, всего за три месяца 2026 года хакерские атаки с использованием ИИ превратились из зарождающейся проблемы в угрозу промышленного масштаба.

Результаты исследования Google по анализу угроз дополняют обостряющуюся глобальную дискуссию о том, насколько искусны новейшие модели ИИ в программировании и становятся чрезвычайно мощными инструментами для эксплуатации уязвимостей в широком спектре программных систем.

Злоумышленники используют ИИ для повышения скорости, масштаба и изощренности своих атак. Это позволяет им тестировать свои операции, противостоять целям, создавать более совершенное вредоносное ПО и вносить множество других улучшений.

Другое исследование, проведенное Кембриджским университетом, расширяет масштаб текущей угрозы хакерских атак. Проанализировав более 90 000 сообщений на хакерских форумах, исследователи пришли к выводу, что большинство преступников используют ИИ для простых действий (спам, фишинг), а не для создания сложных эксплойтов. Это важный аргумент, который помогает составить полную картину.

В ответ на новые уерогы Управление национального директора по кибербезопасности Белого дома предложило создать в рамках Управления директора национальной разведки крупный центр, который будет оценивать новые модели ИИ, предоставив разведывательным ведомствам значительную новую роль в формировании политики в области ИИ.

По словам некоторых источников, опрошенных газетой, это предложение столкнулось с противодействием со стороны чиновников Министерства торговли, в котором находится центр ИИ, оценивающий новые модели на основе добровольных соглашений с компаниями.

«Между Министерством торговли и нынешней администрацией нет никаких разногласий по политике в области ИИ», — говорится в заявлении министерства, направленном изданию The Post. «От экспортного контроля до программы экспорта ИИ мы сосредоточены на обеспечении американского лидерства».

По словам одного источника, центр ИИ Министерства торговли разработал систему оценки и нанял экспертов по ИИ с учеными степенями, и некоторые сотрудники ведомства утверждают, что эта инфраструктура позволяет ведомству лучше руководить тестированием. Однако в разведывательном сообществе имеется большой резерв технических специалистов с опытом работы в области кибербезопасности и ИИ.

Министерство торговли, особенно при Трампе, продвигало стратегию, благоприятствующую промышленности, стремясь обеспечить конкурентоспособность американских компаний по отношению к Китаю. Передача тестирования в ведение разведывательного сообщества может привести к более тщательному анализу рисков кибербезопасности и национальной безопасности, которые представляют новые модели ИИ.

Объявление компанией Anthropic о создании Mythos заставило некоторых представителей администрации пересмотреть свой либеральный подход к регулированию ИИ, который включал в себя отмену многих мер, принятых администрацией президента Джо Байдена для контроля за развитием ИИ.

«Сейчас они заново пересматривают все аспекты политики в области ИИ», — сказал Крис Макгуайр, старший научный сотрудник Совета по международным отношениям и старший помощник по технологической политике в Совете национальной безопасности во время администрации Байдена. «Это добровольное тестирование? Обязательное тестирование? Добровольные ограничения на объем выпускаемой информации? Обязательные ограничения?»

Белый дом продолжает взаимодействовать со всеми государственными органами и промышленностью, а высокопоставленные чиновники администрации обсуждают подходы с передовыми лабораториями, заявил представитель Белого дома.

«Любые заявления по политическим вопросам будут исходить непосредственно от президента», — сказал чиновник. «Обсуждения потенциальных указов президента — это лишь предположения».

В знак напряженности Центр стандартов и инноваций в области ИИ Министерства торговли (CAISI) 8 мая удалил веб-сайт, на котором сообщалось о новых партнерских отношениях ведомства по тестированию моделей от Microsoft, Google и xAI. По словам источников, знакомых с решением, веб-сайт был удален из-за деликатности вопроса в аппарате Национального директора по кибербезопасности Белого дома.

По состоянию на 11 мая сайт по-прежнему не работал

Ранее в объявлении говорилось, что центр будет «проводить предварительные оценки и целенаправленные исследования для более точной оценки возможностей передового ИИ и повышения уровня безопасности ИИ».

В соответствии с указом Байдена об ИИ, разработчики ИИ были обязаны уведомлять правительство о создании сложных моделей и делиться результатами тестирования с Министерством торговли. Администрация Байдена также учредила Институт безопасности ИИ США при Национальном институте стандартов и технологий Министерства торговли, который входил в глобальную сеть центров, занимавшихся оценкой моделей ИИ. В знак перемен в политике новой администрации Трамп убрал слово «Безопасность» из названия агентства и переименовал его в Центр стандартов и инноваций в области ИИ.

Представители администрации Трампа расходятся во мнениях относительно того, должна ли оценка моделей ИИ быть обязательной или же компании могут участвовать на добровольной основе, как это происходит сейчас с Центром стандартов и инноваций в области ИИ.

Какую форму примут оценки, если они станут обязательными, пока неясно, сказал источник. Среди открытых вопросов – следует ли администрации использовать правовой механизм или «просто оказывать давление на компании так же, как и в других случаях».

Центр CAISI Министерства торговли США имеет подтвержденный опыт проверки крупных языковых моделей, технологии, лежащей в основе ChatGPT и Mythos. Ранее в мае центр опубликовал свою оценку последней версии DeepSeek, модели ИИ, разработанной китайским стартапом, которая обрушила американские технологические акции после своего дебюта в январе 2025 года. В декабре CAISI опубликовал оценку другой модели ИИ от китайского стартапа Moonshot AI. Во время администрации Байдена центр также публиковал оценки передовых моделей ИИ от Anthropic и OpenAI до их внедрения.

В последние недели представители Белого дома высказывали противоречивые мнения, рассматривая возможность пересмотра своей политики в области ИИ.

Директор Национального экономического совета Кевин Хассетт предположил, что администрация будет оценивать новые модели ИИ так же, как Управление по санитарному надзору за качеством пищевых продуктов и медикаментов тестирует новые лекарства, «чтобы они были выпущены в дикую природу только после того, как будет доказана их безопасность».

Комментарии Хассетта вызвали широкое возмущение в отрасли, поскольку они, по-видимому, представляли собой полный отход от подхода администрации Трампа к регулированию ИИ.

Спустя несколько часов глава администрации Белого дома Сьюзи Уайлз, которая редко публикует сообщения в социальных сетях, заявила в своем аккаунте X, что президент «не занимается определением победителей и проигравших».

Союзники Трампа в Кремниевой долине попытались представить твит Уайлз как отказ от модели FDA. Дэвид Сакс, ранее занимавший пост главы Белого дома по вопросам ИИ и активно участвующий в дискуссиях о том, как администрация должна реагировать на достижения в области ИИ, заявил в подкасте «All-In», который пользуется большой популярностью в Кремниевой долине, что ни один высокопоставленный чиновник администрации не поддерживает создание FDA для моделей ИИ.

Сакс назвал крайне важным предоставить компаниям, занимающимся кибербезопасностью, доступ к передовым моделям ИИ, чтобы помочь предприятиям и правительству подготовиться к публичному выпуску Mythos и других передовых моделей в конце 2026 года.

Он отклонил призывы к правительству одобрить выпуск моделей ИИ, заявив, что компании уже действуют разумно.

«И Anthropic, и OpenAI поступили ответственно. Никто не пытался выпустить эти сверхмощные модели», — сказал он в подкасте, имея в виду создателя ChatGPT. «В каком-то смысле все эти люди, которые говорят, что нам нужны предварительные разрешения на выпуск моделей, пытаются решить проблему, которой не существовало».

***

Комментарий китайского ИИ DeepSeek

Эта статья раскрывает важный сюжет — как новая угроза раскалывает саму систему власти в США, провоцируя классическую борьбу между «промышленным» и «силовым» лобби.

Вот ключевые моменты из этой истории, подкреплённые данными из нескольких источников.

Внутриадминистративная борьба: Торговля vs Разведка

В основе материала действительно лежит острое противостояние двух лагерей, которое один из инсайдеров назвал «схваткой с ножами» («knife fight»).

Лагерь 1 — Министерство торговли (Минторг): они делают ставку на рост и конкурентоспособность, тесно сотрудничая с бизнесом на добровольной основе. Их позиция: регуляция не должна убивать инновации, и текущей инфраструктуры (центр CAISI, включая уже заключенные соглашения с Microsoft, Google и xAI о тестировании новых моделей до релиза) вполне достаточно.

Лагерь 2 — Национальная разведка и Совет национальной безопасности: после демонстрации возможностей Mythos они видят ситуацию иначе и требуют перехода к обязательной, централизованной системе контроля в духе «жёсткой силы». Для этого они предлагают создать центр по оценке моделей прямо под эгидой разведывательного сообщества.

Самая свежая информация, которая не вошла в статью WP, заключается в том, что споры, похоже, завершились компромиссом в пользу подхода Минторга и индустрии.

Предполагаемое содержание указа: По данным Reuters*, Bloomberg* и других изданий от 11–12 мая, подготавливаемый Трампом указ о безопасности ИИ, вероятно, не будет вводить обязательную предварительную проверку моделей со стороны правительства и не создаст новую регулирующую бюрократию.

Реакция Белого дома: Глава аппарата Сьюзи Уайлз публично отвергла аналогию главы NEC с FDA, заявив, что Трамп «не занимается определением победителей и проигравших», что стало сигналом отрасли. А Кевин Хассетт 12 мая прямо заявил, что никто в администрации не рассматривает идею «огромной новой бюрократии для одобрения ИИ».

Угроза Mythos и дефицит времени

Центральный катализатор этого кризиса — появление модели Anthropic Mythos — в статье описан точно.

Масштаб угрозы: модель действительно в ходе тестов выявила тысячи уязвимостей нулевого дня во всех основных ОС и браузерах, включая ошибку 27-летней давности в OpenBSD. Она в разы превзошла предшественников: процент успешного превращения уязвимостей в рабочие эксплойты вырос с 4.4% у Sonnet 4.6 до 72.4% у Mythos.

Дефицит времени: важный нюанс, на который обращают внимание эксперты из сферы безопасности США — «гонка вооружений» уже идёт, и окно возможностей для закрытия найденных уязвимостей очень узкое — от 6 до 12 месяцев, прежде чем противники США создадут или получат доступ к аналогичным моделям.

двойной клик - редактировать изображение