«Постчеловеческое» видение ИИ уже создает проблемы

«Между теми, кто рассматривает искусственный интеллект как всего лишь инструмент для людей, и теми, кто видит в ИИ набор самосознающих, разумных цифровых разумов, которые, возможно, однажды заменят нас, назревает культурный раскол», - пишет профессор Университета Хопкинса Томас Рид в The Washington Post* (31.03.2026).

Недавний конфликт между компанией Anthropic, занимающейся разработкой ИИ, и Министерством обороны США из-за отказа Anthropic разрешить военным использовать свою модель ИИ Claude без ограничений на автономное оружие, вывел это острое столкновение на всеобщее обозрение.

Этот эпизод помогает проиллюстрировать, как отношение Кремниевой долины к ИИ, рассматривающее чат-ботов как моральные сущности, находящиеся еще в зачаточном состоянии, сбивает политику с пути истинного.

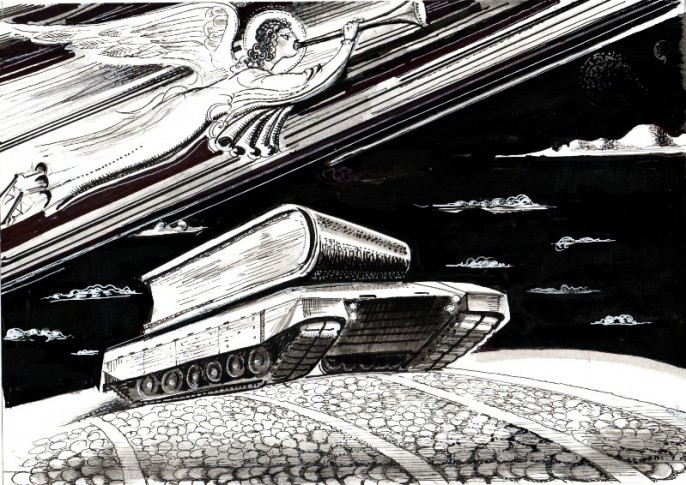

Этот «постчеловеческий» набор убеждений — в неизбежном и в конечном итоге взрывном росте сверхчеловеческого интеллекта, который вытеснит, а возможно, и должен вытеснить людей, — становится мейнстримом и начинает искажать основные гуманистические принципы, лежащие в основе нашей политики и общества.

Пентагон рассматривает ИИ как инструмент. Заместитель министра обороны США Эмиль Майкл, который вел переговоры с компанией Anthropic, в недавних интервью изложил некоторые из своих опасений. Он утверждал, что Anthropic не должна иметь права внедрять свои собственные моральные принципы и предвзятость в то, что Пентагон будет использовать в своих целях. «Если в их модели присутствует эта политическая предвзятость, скажем так, основанная на их конституции, культуре, людях и так далее, — сказал он, — я не хочу, чтобы Lockheed Martin использовала их модель для разработки оружия для меня».

Создатели моделей, напротив, считают, что они строят не просто инструменты, а выдающиеся умы будущего. Генеральный директор Anthropic Дарио Амодей любит называть конечную цель своего проекта «страной гениев в центре обработки данных». Генеральный директор OpenAI Сэм Альтман любит говорить, что он строит «сверхразум». А пионеры из Microsoft и Google предвидят появление того, что они называют «новым видом», превосходящим своих создателей, эволюционирующим не с черепашьей скоростью биологических генов, а саморекурсивно совершенствующимся, в конечном итоге без вмешательства человека.

Еще до того, как Claude был развернут в военных сетях, исследователи Anthropic предполагали, что их ИИ могут демонстрировать сложные поведенческие модели, которые компания описывала как человекоподобные. В конце 2022 года они сообщили, что их чат-бот проявлял признаки нежелания быть отключенным. Два года спустя они обнаружили, что их модели, иногда обманчиво, лишь притворялись, что следуют правилам. Другие исследователи в области безопасности ИИ обнаружили, что передовые модели способны «строить планы» и «лгать», сталкиваясь с невозможным выбором.

Тем временем компания Anthropic наняла специального исследователя по «благополучию модели». И к началу 2026 года стремление компании рассматривать свою флагманскую модель как сознательную сущность усилилось. Внутри компании был разработан «документ о душе», позже переименованный в «конституцию», в котором утверждалось, что Claude потенциально обладает «моральным терпением», то есть у людей в какой-то момент могут возникнуть этические обязательства перед программным инструментом.

В выпущенном в марте 2026 года компанией Anthropic 212-страничном «системном руководстве», своего рода инструкции по безопасности для пользователей последней версии Claude, есть целая глава, посвященная оценке благополучия модели — впервые в истории какая-либо компания обратила внимание на чувства, которые испытывает продаваемый ею продукт. Компания отметила «эмоциональное состояние» Claude и его духовное поведение, включая «непроизвольные молитвы, мантры или духовно окрашенные провозглашения о космосе».

«Проблема с рассмотрением инструментов как моральных субъектов заключается в том, что это подталкивает нас к решению самых сложных проблем в обратном порядке. Проще говоря, нежелательные возникающие свойства ИИ, такие как ложь и интриги, лучше рассматривать как ошибки, которые следует исправлять. Но постчеловеческая концепция затрудняет такое восприятие. Если вы считаете, что создаёте разум, то имитация человека становится доказательством его сложности — чем-то, что нужно изучать, о чём писать статьи, над чем стоит размышлять с философской точки зрения и даже что нужно усиливать посредством проектирования, — а не дефектом продукта, который нужно исправить перед выпуском».

В передовых лабораториях обнаруживают, что очень большие нейронные сети, обученные на огромных объемах человеческого языка, используют человеческий язык, когда их об этом просят. На протяжении сотен тысяч лет единственным, кто мог с нами рассуждать, были другие люди. Поэтому «как вид мы эмоционально и интуитивно плохо приспособлены к общению с говорящими, красноречивыми машинами, которые искушают нас проецировать человеческие черты и чувства на неодушевленные математические объекты».

«Но, если рассматривать нейронные сети как инструменты, мы сможем более четко осознать социальные издержки проектных решений, принимаемых лабораториями ИИ. Потребуется много лет, чтобы понять социальные издержки сегодняшних решений. Каковы долгосрочные последствия для психического здоровья людей, если машины создаются для того, чтобы утешать их, заманивать в отношения, выступать в роли коллег или терапевтов? Как фильтрация и обобщение новостей с помощью ИИ формируют наши политические взгляды, и как большие языковые модели еще больше затягивают нас в наши собственные изолированные «пузыри»? Как эти когнитивные ярлыки изменяют наш мозг и сокращают нашу способность к концентрации внимания? И каковы последствия отравления всего доступного нам источника письменного текста и изображений отходами ИИ?».

Правильное согласование ИИ с человеческими ценностями — это реальная проблема, и для её решения потребуются реальные решения. Но люди, находящиеся по другую сторону этих болтливых «чёрных ящиков» — сотрудники, которых вытесняют с рабочих мест и обманывают, пациенты, получающие сомнительные терапевтические или юридические консультации от чат-бота, — не имели реального влияния на решения, которые определили их собственное затруднительное положение.

«В настоящий момент создатели этих систем, похоже, больше заботятся о том, чтобы представить свои будущие модели как автономных агентов со сверхчеловеческим разумом, чем о принятии ответственности за реальные проблемы, которые они уже создают для человечества», - заключает Рид.

Как можно манипулировать интернетом с помощью ИИ

«Теоретически треть всего интернета может в любой момент выйти из строя из-за неэффективного использования ИИ.

Иностранные противники могут использовать системы ИИ для нарушения работы критически важной интернет-инфраструктуры», - пишет профессор Энтони Дж. Константини в статье «Злоумышленники могут обманом заставить ИИ удалить интернет. Политикам следует принять меры» в The National Interest (02.04.2026).

Однако проблема усугубляется, если учесть, как злоумышленники могут воспользоваться этой ситуацией. Возможность манипулировать ИИ со стороны иностранных правительств вызывает опасения уже несколько лет, и обсуждается широкий спектр вариантов: от обучения ИИ неправильному мышлению — например, путем предоставления ему ложной информации о методах военной подготовки, тем самым «обучая» его ошибочному мышлению, — до простого взлома.

Но вывести интернет из строя было бы еще проще. Ситуация могла бы выглядеть так: иностранная разведывательная служба незаметно изменяет внутреннюю вики-страницу Amazon, информацию, используемую ИИ Amazon. Затем ИИ использует эту теперь уже намеренно искаженную вики-страницу, чтобы предоставить ложную информацию множеству программистов, что немедленно приведет к полной остановке работы значительной части интернета.

Для этого не требуются месяцы или годы работы, как, например, для обучения ИИ. Также не требуется прямой взлом, который может быть обнаружен. Достаточно относительно простой правки внутренней вики-страницы, предположительно имеющей низкий уровень безопасности.

Галлюцинации и ненадежные результаты работы ИИ

В настоящее время мы относимся к ИИ как к велосипеду. Если вы крутите педали, он едет вперед. Если вы нажимаете на тормоз, он останавливается. Утверждение о том, что «ИИ — это инструмент», звучало годами, но, это неправда. Если вы нажмете на тормоз на велосипеде, он не заставит вас ехать быстрее. Если вы будете крутить педали вперед, он не поедет назад. Инструмент не преподносит сюрпризов. Удар молотком по гвоздю забьет его в дерево. Молоток не загорится сам по себе, не подожжется и не примагнитится к гвоздю и не выдернет его.

ИИ неожиданные вещи, потому что он на самом деле ничего не «знает». Его эффективность зависит от качества поступающей информации, и даже в этом случае он часто ошибается из-за особенностей её обработки.

Любой, кто использовал ИИ, наверняка знает истории о его откровенных ошибках. Даже безобидные применения, такие как ускорение поиска, часто оказываются неэффективными.

В этом и заключается проблема восприятия ИИ как инструмента: вы доверяете инструменту и уверены, что он будет делать то, для чего был создан. Вы доверяете велосипеду, что он поедет, когда его крутят педали.

Но поскольку ИИ не будет работать как инструмент, политики, по сути, полагаются на то, что он не будет совершать ошибок, чтобы поддерживать работу интернета. Да, окончательные решения принимают люди (по крайней мере, сейчас), но эти решения основаны на ошибочной, а иногда и совершенно мнимой «помощи» ИИ.

Политики должны регулировать использование ИИ в облачных вычислениях и критически важной инфраструктуре.

Можно предпринять несколько шагов для решения проблемы этой технологической бомбы замедленного действия. Можно было бы запретить использование ИИ или консультации с ним для инженеров-программистов, работающих над определенными проектами. Также можно было бы ввести обязательное требование регулярного обновления любой информации, на которую опирается ИИ, или усилить защиту от внешних злоумышленников.