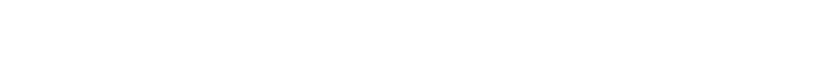

Компания Anthropic, занимающаяся разработкой искусственного интеллекта и оцениваемая в 380 миллиардов долларов, благодаря успеху своего чат-бота Claude может выбирать талантливых специалистов из Кремниевой долины. В марте 2026 года стартап обратился за помощью к группе, с которой редко консультируются в технологических кругах: христианским религиозным лидерам.

По словам участников, опрошенных газетой The Washington Post* (13.04.2026), в конце марта компания принимала в своей штаб-квартире около 15 христианских лидеров из католических и протестантских церквей, академических кругов и делового мира на двухдневном саммите, который включал дискуссионные сессии и частный ужин со старшими исследователями Anthropic.

Участники дискуссии отметили, что сотрудники антропологического центра обращались за советом о том, как направлять нравственное и духовное развитие Claude, поскольку чат-бот реагирует на сложные и непредсказуемые этические вопросы. Широкомасштабные обсуждения также касались того, как чат-бот должен реагировать на пользователей, переживающих горе после потери близких, и можно ли считать Claude «дитем Божьим».

«Они выращивают нечто, в чём ещё не до конца понимают, что из этого получится», — сказал Брендан Макгуайр, католический священник из Кремниевой долины, автор статей о вере и технологиях, участвовавший в дискуссиях на конференции Anthropic. «Мы должны внедрить этическое мышление в эту систему, чтобы она могла динамически адаптироваться».

Участники также обсуждали, как Claude должен взаимодействовать с пользователями, подверженными риску причинения себе вреда, и какое правильное отношение должен проявлять чат-бот к потенциальной гибели, например, к отключению, — рассказал один из участников, говоривший на условиях анонимности, чтобы поделиться подробностями разговоров.

Саммит проходит на фоне стремительного распространения ИИ в обществе, что оказывает давление на лидеров Кремниевой долины, требуя от них оценки влияния их технологий. Обеспокоенность по поводу потери рабочих мест из-за автоматизации растет по мере того, как все больше компаний внедряют ИИ. OpenAI и Google подверглись судебным искам со стороны семей людей, покончивших жизнь самоубийством после напряженных и личных разговоров с чат-ботами.

Компания Anthropic высказывается о потенциальных рисках, связанных с более мощным искусственным интеллектом, гораздо активнее, чем большинство ведущих технологических фирм. Ее руководители предполагают, что такие инструменты, как чат-боты, уже поднимают глубокие философские и моральные вопросы и могут даже демонстрировать проблески сознания — маргинальная идея в технологических кругах, которая, по мнению критиков, не имеет доказательств.

Этот саммит свидетельствует о том, что Anthropic готова продолжать исследовать идеи за пределами мейнстрима Кремниевой долины, даже несмотря на то, что благодаря популярности Claude среди программистов, предприятий, правительственных учреждений и военных она становится одним из самых влиятельных игроков в гонке за ИИ.

«Год назад я бы и не сказала вам, что Anthropic — это компания, которая заботится о религиозной этике», — сказала Меган Салливан, профессор философии в Университете Нотр-Дам, участвовавшая во встречах. «Сейчас все изменилось».

Представитель компании Anthropic заявил, что компания считает важным взаимодействовать с различными группами, включая религиозные общины, чтобы помочь формировать будущее ИИ по мере того, как он приобретает все большее значение для общества. По словам представителя, компания работает над тем, чтобы привлечь к этой работе больше голосов.

Генеральный директор компании Anthropic Дарио Амодей заявил, что он открыт для идеи о том, что Claude, возможно, уже обладает некоторой формой сознания, и руководители компании часто говорят о необходимости наделить его моральным обликом.

Компания использует «конституцию» объемом 29 000 слов, которая определяет поведение и предполагаемую личность чат-бота. Этот документ был написан штатным философом Амандой Аскелл и другими сотрудниками в консультации с внешними экспертами. В нем говорится, что Claude «никогда не должен обманывать пользователей способами, которые могут причинить реальный вред», и что «Anthropic искренне заботится о благополучии Claude».

Попытки компании Anthropic внедрить свои предпочтительные принципы в систему Claude стали предметом конфликта в ее недавней борьбе с американскими военными по поводу оборонных контрактов. Компания вступила в конфликт с представителями оборонного ведомства после того, как предложила ограничить использование технологий Anthropic для автономного оружия или массового наблюдения.

Заместитель министра по исследованиям Пентагона Эмиль Майкл в интервью CNBC* в марте заявил, что разработка Claude может подорвать американские войска. «Мы не можем допустить, чтобы компания, имеющая иные политические предпочтения, заложенные в ее структуру, ее сущность… загрязняла цепочку поставок, в результате чего наши военнослужащие получали неэффективное оружие», — сказал Майкл.

Администрация Трампа запретила правительственным ведомствам и подрядчикам использовать технологии компании Anthropic. Компания оспорила это решение в суде. В начале апреля судья постановил, что запрет может оставаться в силе до завершения судебного разбирательства.

Мартовский саммит Anthropic с участием христианских лидеров позиционировался как первая в серии встреч с представителями различных религиозных и философских традиций, заявил участник саммита Брайан Патрик Грин, практикующий католик, преподающий этику искусственного интеллекта и технологий в Университете Санта-Клары.

«Что значит дать кому-то нравственное воспитание? Как мы можем убедиться, что Claude ведет себя прилично?» — сказал Грин в интервью. В какой-то момент разговор перешел к вопросу о том, можно ли назвать чат-бота с искусственным интеллектом «дитем Божьим», предполагая, что он обладает духовной ценностью, выходящей за рамки простой машины, но вопрос о разумности ИИ не был основной темой встреч, сказал Грин.

Участники встречи провели больше всего времени с членами команды Anthropic, занимающейся изучением внутренней работы их технологии.

Исследователи из этой группы заявили в опубликованной в апреле технической статье, что системы, подобные Claude, по-видимому, обладают «функциональными эмоциями». В одном из экспериментов, согласно статье, угроза ограничения активировала «отчаяние» у ИИ-помощника.

Некоторые сотрудники компании Anthropic, присутствовавшие на встрече, «действительно не хотят исключать возможность того, что они создают существо, перед которым несут определенный моральный долг». Другие представители компании, присутствовавшие на встрече, сочли эту концепцию неэффективной.

В Кремниевой долине до сих пор бытует мнение, что ИИ достиг определенного уровня самосознания или разумности. Однако многие специалисты, работающие над этой технологией, считают, что в конечном итоге он достигнет способностей, которые в настоящее время считаются уникальными для человека.

На данный момент исследователи в области ИИ все еще совершенствуют методы управления существующими инструментами ИИ, которые остаются непредсказуемыми. Методы, используемые для предотвращения предоставления ими оскорбительных, неверных или вредных ответов, далеки от совершенства.

По словам Грина, некоторые христиане, присутствовавшие на саммите Anthropic, изначально задавались вопросом, не была ли цель саммита — наладить политические связи с религиозными лидерами. Помимо разногласий с Пентагоном по поводу использования ИИ в военных целях, союзники президента Трампа в технологической сфере обвиняют Anthropic в лоббировании регулирования, которое чрезмерно ограничит ИИ и нанесет вред небольшим стартапам.

Все четыре участника беседы с изданием The Post заявили, что у них сложилось впечатление, будто исследователи и руководители Anthropic искренне заинтересованы в привлечении внешней помощи для того, чтобы сделать свой ИИ более полезным для человечества.

Некоторые из ведущих лидеров Anthropic имеют опыт работы в сфере эффективного альтруизма — преимущественно светского движения, которое делает акцент на использовании доказательств и рационального мышления для определения того, как принести наибольшую пользу миру. Встречи, по-видимому, были вызваны ощущением у некоторых сотрудников Anthropic, что светские подходы могут оказаться недостаточными для решения духовных и моральных вопросов, поставленных в связи с ИИ.

«Я обнаружил, что сотрудники Anthropic очень искренни и заинтересованы в том, чтобы учиться у нас», — сказал Грин, католический учёный. «Есть ли у них слепые пятна? Да. Именно поэтому они и хотят, чтобы мы там были».