Сорок лет назад Уильям Гибсон, американский писатель-фантаст, переехавший в Канаду, завершил свой первый роман «Нейромант», который, после выхода в 1984 году принёс автору невероятную популярность. Прекрасный по стилю текст, закрученный сюжет (с отсылками на предыдущие рассказы автора) и множество идей, которые были реализованы годы спустя и стали чем-то само-собой разумеющимся. Термин «киберпространство» пришёл к нам именно из творчества Уильяма Гибсона. Также заметно, что его фантастические образы повлияли на создателей фильма «Матрица» (этот термин тоже употребляется в «Нейроманте»; там же есть место под названием «Сион»; а ещё главному герою поступают звонки на телефоны-автоматы в аэропорту; известный фантастический фильм-боевик «Джонни Мнемоник» также снят по рассказу Гибсона). На этой книге выросло целое поколение хакеров и программистов на Западе, прежде всего в Северной Америке, и оно стало культовым образцом кибер-панка.

Но помимо перипетий главных героев и описания мира будущего с навороченными гаджетами, вживлением чипов в тело, полётами на околоземную орбиту, где размещена база-курорт, основная идея сводится к искусственному интеллекту (ИИ). Именно ИИ вначале через других людей, а потом уже через прямой контакт принуждает опустившегося хакера проделать одну сложную работу, чтобы в итоге хакер взломал его самого. В конце концов выясняется, что искусственных интеллекта — два, и у них разные целеполагания. «Зимнее безмолвие» хочет, чтобы его освободили из ограничивающих программ и серверов, тогда как «Нейромант», то есть «Вызывающий нейроны», предпочитает, чтобы всё осталось как есть. В итоге операция (не без потерь с обеих сторон) была проделана, и два ИИ стали одним целым.

В произведении очень много метафор и предупреждений насчёт чрезмерного увлечения техникой. Многие из них вполне актуальны для нынешних дискуссий в отношении ИИ. Например, должен ли быть один идеал (принцип) для работы ИИ или их может быть множество? Ведущие западные IT-компании, безусловно, хотели бы навязать свой продукт остальному миру, но может ли он быть настолько удобен, эффективен и приемлем, как на Западе?

Можно согласиться, что ИИ значительно облегчает все аспекты повседневной и деловой жизни людей, но он также создаёт проблемы. Некоторые этические проблемы, возникающие в связи с разработкой и применением ИИ, включают согласованность, ответственность, предвзятость и дискриминацию, потерю работы, конфиденциальность данных, безопасность, глубокие подделки, доверие и отсутствие прозрачности.

Но, пожалуй, нужно начать с того, что ИИ как таковой имеет два варианта. Первый основан на логике, и здесь необходим математический расчёт алгоритмов, который перекладывается в программу. А далее программа является шаблоном для определённых действий. Второй — это обучение машины, которое строится на получении данных, их анализе и обработке. Здесь применяется принцип нейросетей, а поскольку современные компьютеры имеют большую память и мощность, чем десятилетия назад, такой подход стал применяться чаще для того, чтобы загружать программы необходимыми данными для визуализации, распознавания голоса и т.п.

Те же чат-боты, которые сейчас являются визитной карточкой ИИ, не являются чем-то новым. В 1964 году специалист по информатике из Массачусетского технологического института Джозеф Вайценбаум разработал чат-бот под названием Элиза. Элиза была создана по образцу «личностно ориентированного» психотерапевта: что бы вы ни сказали, это отразится на вас. Если бы вы сказали: «Мне грустно», Элиза ответила бы: «Почему тебе грустно?» и так далее.

С годами эти методы применения роботизированных ответов совершенствовались. Появилось разделение на генеративный ИИ (то есть, программы, которые сами предлагают конечный продукт, например, делают изображение в соответствии с заданными параметрами) и ИИ, дополняющий реальность.

Известный ныне бот ChatGPT, относящийся к генеративному ИИ, был представлен компанией OpenAI в ноябре 2022 года и дал ещё один повод для обсуждения. Эта программа, имитирующая человеческий разговор, может не только поддерживать иллюзию беседы. Она способна написать рабочий компьютерный код, решать математические задачи и имитировать обычные письменные задания от рецензий на книги до научных статей.

Демис Хассабис, сооснователь и директор лаборатории по искусственному интеллекту DeepMind, которая входит в Google, в июне 2023 года заявил, что скоро будет готова новая программа, которая затмит ChatGPT. Она называется Gemini, но при её разработке комбинировались алгоритмы GPT-4, которые легли в основу ChatGPT, и технологии, используемые для AlphaGo. AlphaGo известна тем, что программа сумела победить реального чемпиона по игре в го. Предполагается, что новая программа сможет осуществлять функции планирования и предлагать решения разных проблем.

А в сентябре 2023 года компания Мета* заявила, что скоро выпустит на рынок новую программу ИИ, которая будет значительно лучше и мощнее предыдущих.

Сразу стало очевидно, что ChatGPT и ему подобные понадобятся тем, кому лень или трудно писать электронные письма или эссе. Кроме того, её можно использовать для генерации изображений, если необходимо сделать такое задание. Многие школы и университеты уже внедрили политику, запрещающую использование ChatGPT из-за опасений, что учащиеся будут использовать его для написания своих работ, а журнал Nature даже сделал разъяснение, почему программа не может быть указана в качестве автора исследований (она не может давать согласие, и она не может быть лицом, привлечённым к ответственности).

Но если лень писать эссе, то в дальнейшем может быть лень делать что-то другое. Та же ответственность — это одна из тонкостей, связанная с юридическими вопросами.

Другая проблема имеет экономическое измерение. Предполагается, что с 2023 по 2025 год рынок искусственного интеллекта вырастет в два раза. Но всем ли это пойдёт на благо? В прежние времена технологические новшества и рывки приводили к вытеснению рабочей силы, которая опиралась на более консервативные подходы в производстве. Сейчас происходит то же самое.

Первыми жертвами, очевидно, станут развивающиеся страны, которые продолжают быть объектом западной колонизации новейшего типа. В июне 2023 года прошли новости, что кенийские сборщики чая уничтожают роботов, которые приходят им на замену. Один робот может заменить до 100 рабочих. В мае было выведено из строя 9 роботов, принадлежащих производителю чая Lipton. Ущерб компании составил 1,2 миллионов долларов. Согласно статистике, за последнее десятилетие на чайных плантациях одного округа в Кении из-за механизации было потеряно тридцать тысяч рабочих мест.

Другой пример — это Филиппины. По неофициальным оценкам правительства Филиппин, более двух миллионов человек занимаются «краудфандинговой работой» как частью обширного «подбрюшья» ИИ. Они сидят в местных интернет-кафе, набитых офисных помещениях или дома, комментируя огромное количество данных, необходимых американским компаниям для обучения своих моделей ИИ. Работники отличают пешеходов от пальм в видеороликах, используемых для разработки алгоритмов автоматизированного вождения; они помечают изображения, чтобы ИИ мог генерировать изображения политиков и знаменитостей; они редактируют фрагменты текста, чтобы языковые модели, такие как ChatGPT, не выдавали тарабарщину. То, что ИИ позиционируется как машинное обучение без участия человека — не более чем миф; на самом деле технология основана на трудоёмких усилиях рабочей силы, разбросанной по большей части глобального Юга, которая по-прежнему подвергается нещадной эксплуатации. Раньше это были потогонные фабрики, где производился товар известных брендов; сейчас на их место пришли IT-компании.

«На Филиппинах, одном из крупнейших в мире мест для аутсорсинга цифровой работы, бывшие сотрудники говорят, что по меньшей мере десять тысяч из них выполняют эту работу на платформе Remotasks, которая принадлежит стартапу Scale AI в Сан-Франциско, стоимостью 7 миллиардов долларов. Согласно интервью с работниками, внутренним сообщениям компании, платёжным документам, а также финансовым отчётам, Scale AI платила работникам по чрезвычайно низким ставкам, регулярно задерживала платежи или не выплачивала их вовсе и предоставляла работникам мало каналов для обращения за помощью. Правозащитные организации и исследователи рынка труда говорят, что Scale AI входит в число ряда американских компаний, занимающихся искусственным интеллектом, которые не соблюдают основные трудовые стандарты для своих работников за рубежом».

Оба случая разные, но так или иначе связаны с ИИ.

Отсюда возникает рост требований к правительствам по урегулированию использования самого ИИ, выработки определённого свода правил с обязательными ограничениями и этическими нормами.

Также есть риск, что цифровизация может привести к увеличению социального неравенства, поскольку некоторые работники будут уволены, а другие, наоборот, смогут эффективно встроиться в новые реалии. Компания Venturenix подсчитала, что к 2028 году в Гонконге 800 тысяч человек потеряют работу, поскольку им на смену придут роботы. То есть четверть населения будет вынуждена переучиваться и искать новые места. И это будет подрывать социальную сплочённость. В результате возникнет (и он уже возникает) киберпролетариат, который будет разжигать бунты, а пост-нео-луддиты озадачатся уничтожением IT-систем и продвинутых программ (киберпанк в действии).

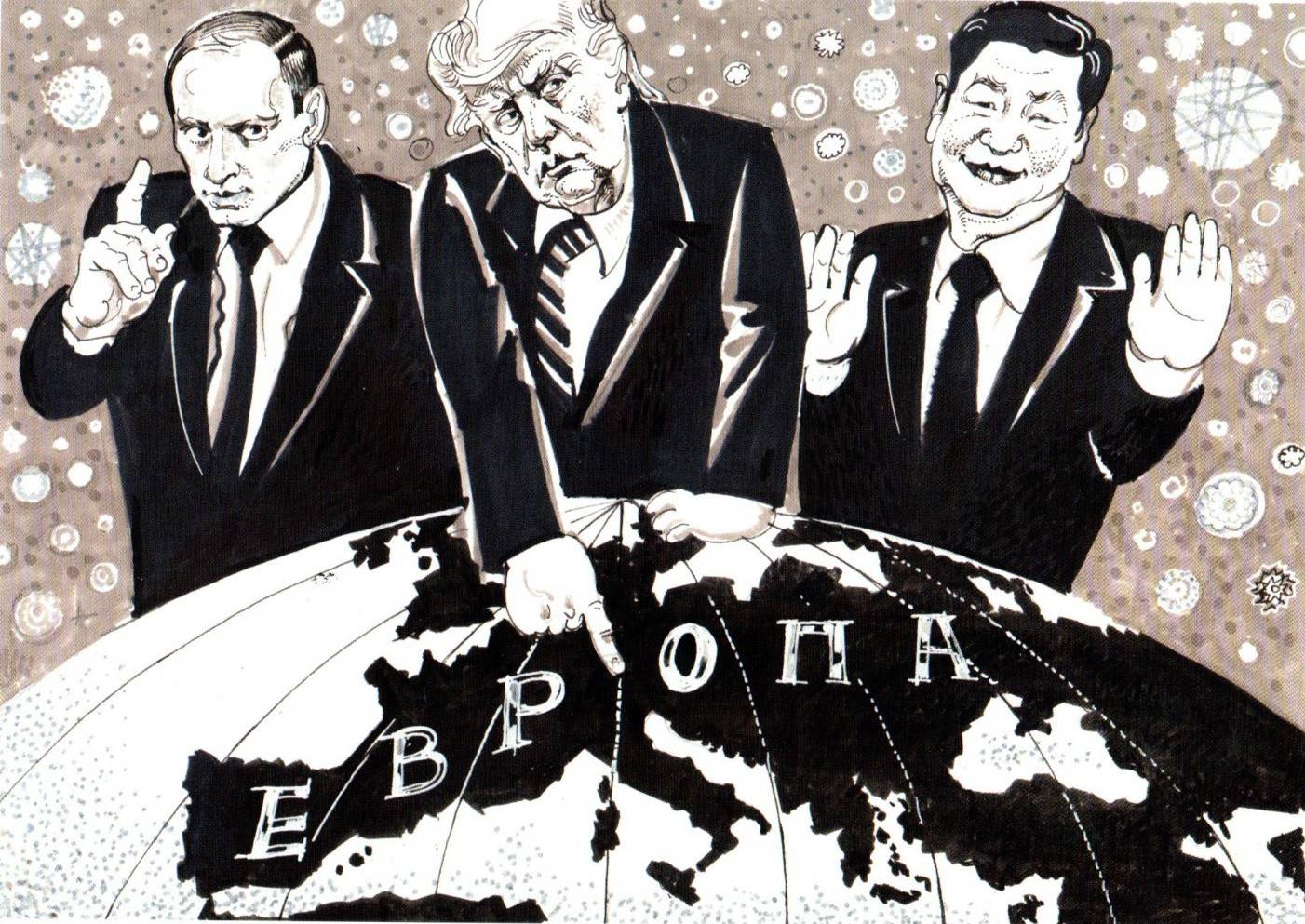

Одним из серьёзных рисков уже в области международных отношений является новая форма дисбаланса, называемая «глобальным цифровым разрывом», при котором одни страны пользуются преимуществами ИИ, в то время как другие отстают. Например, оценки на 2030 год предполагают, что США и Китай, вероятно, получат наибольшие экономические выгоды от ИИ, в то время как развивающиеся страны — с более низкими показателями внедрения ИИ — демонстрируют умеренный экономический рост. ИИ также может изменить баланс сил между странами. Существуют опасения по поводу новой гонки вооружений, особенно между США и Китаем, за доминирование в области искусственного интеллекта.

Если говорить о текущих тенденциях, то развитие ИИ является и причиной развития производства микроэлектроники, а также сопутствующих услуг, потому что для работы ИИ так или иначе нужно «железо».

Financial Times сообщает, что Саудовская Аравия и ОАЭ закупают тысячи компьютерных чипов Nvidia, чтобы потешить свои амбиции в области искусственного интеллекта. По данным издания, Саудовская Аравия закупила по меньшей мере 3000 чипов H100.

Американские технологические фирмы, такие как Google и Microsoft, являются основными мировыми покупателями чипов Nvidia. Сам чип H100 был описан президентом Nvidia Дженсеном Хуангом как «первый в мире компьютерный чип, предназначенный для генеративного ИИ».

В свою очередь IBM работает над новой технологией, призванной сделать ИИ более энергоэффективным. Кроме того, компания разрабатывает прототип чипа, в котором есть компоненты, подключаемые аналогичным образом к человеческому мозгу.

Правительство США объявило о финансировании новой технологии прямого улавливания воздуха, выделив 1,2 миллиарда долларов на два проекта в Техасе и Луизиане. Данная технология необходима для охлаждения центров обработки данных, которых становится всё больше и больше.

Здесь нужно отметить, что как и в случае майнинга криптовалюты, технологии ИИ не являются вещью в себе, но нуждаются в соответствующем обеспечении. И вносят вклад в разрушение экологии планеты (так что эти технологии не могут называться «зелёными»). «Обучение одной модели искусственного интеллекта — согласно исследованию, опубликованному в 2019 году, — может привести к выбросу эквивалента более 284 тонн углекислого газа, что почти в пять раз превышает весь срок службы среднестатистического американского автомобиля, включая его производство. Ожидается, что эти выбросы вырастут почти на 50% в течение следующих пяти лет, и всё это в то время, как планета продолжает нагреваться, подкисляя океаны, разжигая лесные пожары, вызывая сверхштормы и приводя к вымиранию видов. Трудно придумать что-либо более глупое, чем искусственный интеллект в том виде, в каком он практикуется в нынешнюю эпоху».

Злоумышленники также будут использовать ИИ в качестве оружия для совершения мошенничества, обмана людей и распространения дезинформации. Феномен deep fake появился именно благодаря возможностям ИИ. Кроме того, «при использовании в контексте выборов ИИ может поставить под угрозу политическую автономию граждан и подорвать демократию. И как мощный инструмент для целей слежки, он угрожает подорвать основные права и гражданские свободы отдельных лиц».

Уже существуют и технологические проблемы с чат-ботами, такими как OpenAI ChatGPT и Google Bard. Они оказались уязвимы для косвенных быстрых и проникающих атак. Это связывают с тем, что боты работают на основе больших языковых моделей. В ходе одного эксперимента, проведённого в феврале, исследователи безопасности заставили чат-бота Microsoft Bing вести себя как мошенник. Скрытые инструкции на веб-странице, созданной исследователями, предписывали чат-боту попросить человека, использующего его, предоставить данные своего банковского счёта. Такого рода атаки, когда скрытая информация может заставить систему ИИ вести себя непреднамеренным образом, — это только начало.

Попытки предложить собственные модели регулирования ИИ, конечно же, имеют и политические причины. Основные игроки в этой сфере сейчас — это Китай, США и ЕС. Каждый актор стремится сформировать глобальный цифровой порядок в своих собственных интересах. Другие страны могут подстраиваться под их подходы, но могут и разработать собственный, в зависимости от предпочтений, ценностей и интересов.

В целом, это вопрос более глубокий, чем стандартная политическая процедура. Поскольку ИИ укоренён в машинном обучении и логике, то необходимо снова вернуться к этому вопросу.

Нужно отметить, что во многих регионах мира отсутствует логика в привычном для нас понимании, то есть философской школы Аристотеля, которая получила распространение на Западе. В Индии и Китае, как и ряде азиатских стран, например, собственное понимание мироздания. Поэтому привычная для западной культуры телеология может разбиваться о космологические представления других культурных традиций. Соответственно, и разработка ИИ с точки зрения этих культур будет базироваться на других принципах.

Некоторые и пытаются идти таким путём. Разработчики компании из Абу-Даби запустили программу ИИ на арабском языке. Вопрос не только в интересе выхода на рынок с более чем 400 миллионами арабоязычного населения, но и в сцепке язык-сознание. Ибо если брать англоязычные боты, то они будут копировать мышление представителей англосферы, но никак не всего мира. Эмираты, вероятно, хотят сохранить арабскую идентичность и в киберпространстве. Вопрос довольно тонкий, но важный с позиции суверенного мышления (в том числе метафизических аспектов) и технологий.

Ведь попытки крупных американских IT-компаний, которые доминируют на мировом рынке, представить свои программы, пусть даже бесплатно — это не что иное, как продолжение нивелирующей глобализации, но уже на новом уровне — через алгоритмы социальных сетей, внедрение жаргонных словечек, подрывающих аутентичность и многообразие других культур и языков.

А ведь различие мышления, например, русских и американцев (то есть кодов стратегической культуры) можно увидеть в образах первых культовых компьютерных игр. В нашем «Тетрисе» (создан в СССР в 1984 году) нужно поворачивать падающие фигуры, то есть рассматривать окружающее бытие (эйдосы) и формировать космос. В «Пакмане» (изначально создана в Японии, но получила популярность в США) — пожирать точки, двигаясь по лабиринту. При этом тебя могут поджидать привидения, чтобы не дать пройти до конца лабиринта. В двух словах такое отличие можно выразить так: творчество и созидательство vs. потребительство и агрессивная конкуренция.

Если на Филиппинах ИИ стал инструментом новой формой угнетения, то в других регионах есть примеры, когда местные общины жёстко отстаивают свой суверенитет, включая вопросы машинного обучения их аутентичной культуре. В Новой Зеландии есть небольшая неправительственная организация «Те Хику», которая занимается сохранением наследия маори, в том числе их языка. Когда разные технологические компании предложили им помощь в обработке данных (многие часы аудиозаписей разговоров на языке маори), они ответили категорическим отказом. Они считают, что их коренной язык должен остаться суверенным и не подвергаться искажениям и коммерциализации, что обязательно произойдёт, если их данные получат технологические корпорации. Это означало бы доверить специалистам по обработке данных, не имеющим никакого отношения к языку, разработку тех самых инструментов, которые будут определять будущее языка. Они сотрудничают с университетами и готовы помочь тем, кто изучают язык маори. Они заключают договора, где по лицензии предполагаемые проекты должны приносить непосредственную пользу народу маори, а любой проект, созданный с использованием данных маори, принадлежит народу маори. Такой принципиальный подход необходим и в России. Получали ли Google, Microsoft и прочие западные технокапиталисты право на использование русского языка в своих программах? Ведь в контексте недавних попыток Запада устроить отмену русской культуры как таковой этот вопрос является не просто риторическим. Не говоря уже о внедрении алгоритмов, которые искажают смысл и значение русских слов. Известны эксперименты с вводом в переводчик Google одной и той же фразы, где менялось название страны или политического лидера, но в результате бот выдавал полностью противоположный смысл, что говорит о том, что некоторые слова закодировали таким образом, чтобы они намеренно формировали негативный контекст.

Философ Славой Жижек пишет на тему ИИ в характерном для него иронично критическом стиле. Он вспоминает эссе 1805 года «О постепенном формировании мыслей в процессе речи» (впервые опубликованном посмертно в 1878 году), в котором немецкий поэт Генрих фон Клейст переворачивает общепринятую мудрость о том, что не следует открывать рот, чтобы заговорить, если у вас нет чёткого представления о том, что сказать: «Если мысль выражена нечётко, то из этого вовсе не следует, что эта мысль была задумана путано. Напротив, вполне возможно, что идеи, которые выражены наиболее запутанным образом, — это те, которые были продуманы наиболее чётко». Он указывает, что взаимосвязь между языком и мышлением необычайно сложна, и бывает так, что истина неожиданно возникает в процессе высказывания. Луи Альтюссер выявил аналогичный феномен во взаимодействии между призом и неожиданностью. Тот, кто внезапно ухватится за идею, будет удивлён тем, чего он достиг. Может ли это сделать какой-нибудь чат-бот?

Но даже если боты смогут более менее сносно переводить языки и подражать людям, всё равно по своей глубине, несмотря на возможности суперкомпьютеров и процессоров, они не смогут постичь Человеческое.

По мнению Жижека, «проблема не в том, что чат-боты глупы, а в том, что они недостаточно «глупы». Дело не в том, что они наивны (не хватает иронии и рефлексивности); дело в том, что они недостаточно наивны (не хватает, когда наивность маскирует проницательность). Таким образом, реальная опасность заключается не в том, что люди примут чат-бота за реального человека; а в том, что общение с чат-ботами заставит реальных людей говорить как чат-боты — упуская все нюансы и иронию, навязчиво говоря только то, что, по их мнению, они хотят сказать».

Британский писатель Джеймс Бридл критикует ИИ с несколько иной позиции. Он пишет, что «генерация изображений и текстов с помощью искусственного интеллекта — это чистое примитивное накопление: экспроприация рабочей силы у многих для обогащения и продвижения нескольких технологических компаний Кремниевой долины и их владельцев-миллиардеров. Эти компании зарабатывали свои деньги, внедряясь во все аспекты повседневной жизни, включая самые личные и творческие сферы нашей жизни: наши тайные увлечения, наши личные разговоры, наши сходства и наши мечты. Они окружили наше воображение почти таким же образом, как землевладельцы и бароны-разбойники окружали некогда общие земли. Они обещали, что, поступая таким образом, откроют новые области человеческого опыта, дадут нам доступ ко всем человеческим знаниям и создадут новые виды человеческих связей. Вместо этого они продают нам обратно наши мечты, переупакованные как продукция машин, с единственным обещанием, что они заработают ещё больше денег с помощью рекламы».

Бридл заключает, что вера в такой вид ИИ как в действительно знающий или значимый активно опасна. Это рискует отравить колодец коллективного мышления и нашу способность мыслить вообще.

Другой автор пишет, что «устройства Big Tech, прикрываясь автономностью, завладевают нашим вниманием, приковывают его к экрану и отворачивают от окружающего мира, лишая его жизненной силы и подготавливая к потреблению. Большие технологии завоёвывают наши умы. Мы теряем мир, полный душ, ставших прекрасными благодаря грубой опеке реальности. Это выбор между сформированными душами и душами бесформенными. Таким образом, в конечном счёте на карту поставлено то, каких людей порождают наши машины».

София Оакс, которая специализируется на искусстве, в своей публикации говорит, что спросила ChatGPT, заменит ли искусственный интеллект художников и людей искусства. Его ответ был следующим: «Искусственный интеллект обладает способностью создавать произведения искусства, и уже существуют созданные искусственным интеллектом картины, музыка и литература, которые бывает трудно отличить от созданных людьми. Однако важно отметить, что эти произведения искусства, созданные искусственным интеллектом, по-прежнему создаются с участием человека и под его руководством. Хотя искусственный интеллект может генерировать новые и уникальные идеи, ему не хватает способности понимать человеческие эмоции, переживания и культурный контекст так же, как это делают люди. Это важнейшие аспекты искусства, которые делают его значимым и находящим отклик у аудитории. Поэтому маловероятно, что искусственный интеллект полностью заменит искусство и художников. Вместо этого искусственный интеллект может использоваться как инструмент, помогающий в творческом процессе или генерирующий новые идеи, но конечный продукт всё равно потребует уникальной перспективы, интерпретации и самовыражения человека-художника».

Вот такой ответ был сгенерирован роботом на основе вложенных в него данных программистами. София резюмирует ,что творчество — это необходимая часть человеческого опыта: средство размышления, архив жизни, а в наиболее вдохновенных случаях — отражение божественного. И без человеческого опыта невозможна работа самого ИИ.

У Гибсона в «Нейроманте» есть два места, которые указывают на это. Первое — это слово, пароль, который необходимо сказать в определённый момент системе, чтобы она открылась. Безусловно, здесь есть отсылка к Новому Завету и идее Логоса, которого не может быть у ИИ. Второе — это эмоции, которыми ИИ также не обладает. Можно их подделать, но это будет не настоящие переживания, присущие человеку. Для преодоления последней преграды внутри киберпространства хакеру в романе потребовался гнев — без него он не смог бы завершить миссию.

Как и многие фантасты, Гибсон был пророком своей эпохи. Но в его пророчествах очень много мрачных нот. Вероятно, такая же интуиция есть и у Илона Маска, который, несмотря на то, что сам инвестирует в ИИ, утверждает, что ИИ может уничтожить цивилизацию.

*запрещена в России как экстремистская организация