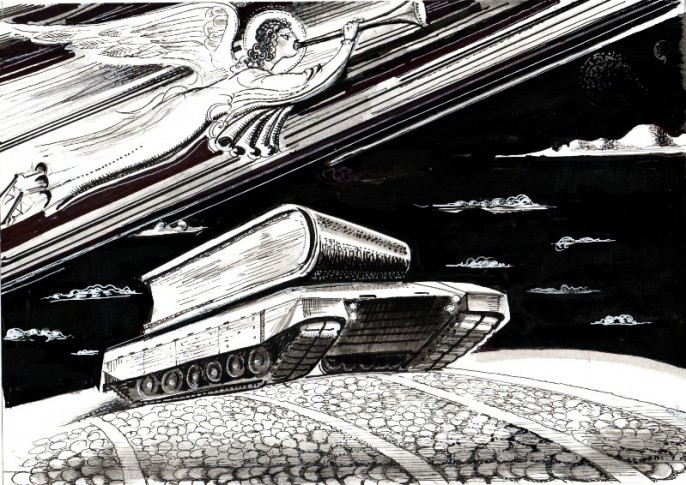

Военный конфликт на Украине в числе многих проблем показал, что достижения в области искусственного интеллекта (ИИ) открывают огромные возможности для военных. Учитывая растущий потенциал военных систем с поддержкой ИИ, некоторые активисты бьют тревогу, призывая к ограничениям или прямым запретам на некоторые системы вооружений с поддержкой ИИ. И наоборот, скептики контроля над вооружениями ИИ утверждают, что ИИ будет исключительно трудно контролировать. ИИ - это технология, позволяющая использовать бесчисленные невоенные приложения. Этот фактор отличает его от многих военных технологий, таких как наземные мины или ракеты. Из-за широкой доступности абсолютный запрет на все военные применения ИИ, вероятно, неосуществим. Однако существует возможность запрета или регулирования конкретных вариантов использования.

Международное сообщество временами запрещало или регулировало оружие с разной степенью успеха. В некоторых случаях контроль над вооружениями работал хорошо. Однако в других случаях, таких как попытки ограничить неограниченную подводную войну или воздушные бомбардировки городов, государствам не удалось добиться длительного сдерживания в войне. Мотивы государств для контроля или регулирования вооружений различаются. Государства могут стремиться ограничить распространение оружия, которое особенно подрывает политическую или социальную стабильность, способствует чрезмерным жертвам среди гражданского населения.

В связи с этим интересен документ Центра новой американской безопасности «Искусственный интеллект и контроль над вооружениями» (авторы – Поль Шарр, виц – президент и директор по исследованиям Центра и Меган Ламберт, сотрудник Центра), опубликованный 12.10.2022. В нем рассматривается потенциал контроля над вооружениями для военного применения ИИ путем изучения исторических случаев попыток контроля над вооружениями, анализа как успехов, так и неудач. В документе также анализируется потенциал контроля над вооружениями ИИ и предлагаются определенные шаги для политиков.

Понимание контроля над вооружениями

“Контроль над вооружениями” - это широкий термин, который может охватывать множество различных действий. Как правило, он относится к соглашениям, которые государства заключают для контроля над исследованиями, разработкой, производством, использованием или применением определенного оружия, а также системами доставки оружия.

Виды контроля над вооружениями

Контроль над вооружениями может осуществляться на многих этапах разработки и применения оружия. Режимы нераспространения, такие как договор о нераспространении ядерного оружия (ДНЯО), направлены на предотвращение доступа к технологиям, лежащим в основе определенных видов оружия. Запреты, такие как запрет на наземные мин и кассетных боеприпасов, разрешают доступ к технологии, но запрещают разработку, производство или накопление оружия. Договоры об ограничении вооружений разрешают производство; они лишь ограничивают количество определенного оружия, которое страны могут иметь в мирное время. Другие соглашения регулируют использование оружия на войне, ограничивая его использование определенными способами или полностью запрещая его использование.

Контроль над вооружениями может осуществляться различными способами, включая юридически обязательные договоры, обычное международное право, вытекающее из практики государств, или не имеющие обязательной юридической силы документы. Успешный контроль над вооружениями может осуществляться даже посредством негласных соглашений, которые прямо не оговариваются между государствами, но, тем не менее, приводят к взаимной сдержанности.

Контроль над вооружениями между государствами является скорее исключением, чем правилом. Большую часть времени государства конкурируют в области военных технологий без формальных или неформальных механизмов контроля над вооружениями, ограничивающих их конкуренцию. Существует несколько факторов, которые затрудняют контроль над вооружениями. Контроль над вооружениями требует определенной степени координации и доверия между государствами, и обстоятельства, в которых контроль над вооружениями наиболее необходим — интенсивная милитаризованная конкуренция или война, — это те, в которых координация и доверие наиболее сложны. Мониторинг и проверка, которые могли бы обеспечить доверие, также являются проблемой, поскольку та же прозрачность, которая может развеять опасения конкурентов по поводу разработки оружия, может одновременно выявить уязвимости в собственных вооруженных силах, что заставляет государства неохотно принимать такие меры.

Несмотря на это давление, государствам иногда удавалось сдерживать разработку или использование оружия. Даже в разгар тотальной войны государства стремились к взаимной сдержанности и воздерживались от использования определенного оружия или тактики, которые привели бы к эскалации боевых действий.

Факторы, влияющие на успех или неудачу контроля над вооружениями

Авторы документа ссылаются на Шона Уоттса и Ребекку Крутоф, которые проанализировали исторические случаи контроля над вооружениями, чтобы определить, какие социальные, правовые и технологические факторы влияют на успех контроля над вооружениями.

Шон Уоттс выделяет шесть критериев, которые, по их мнению, влияют на возможность регулирования оружия: эффективность, новизна, развертывание, медицинская совместимость, разрушительность и известность. Эффективное оружие, которое обеспечивает “беспрецедентный доступ” к вражеским целям и обладает способностью обеспечивать доминирование, исторически устойчиво к регулированию. На протяжении всей истории существует неоднозначный опыт регулирования новых видов оружия или военных систем. Страны добиваются регулирования некоторых новых видов оружия или систем доставки оружия (например, бомбардировки с воздуха), одновременно сопротивляясь регулированию других новых военных систем (например, подводных лодок). Оружие, которое широко используется в военные операции государств, как правило, не поддается контролю над вооружениями. Оружие, которое наносит “раны, совместимые с существующими медицинскими протоколами” в военных и полевых госпиталях, исторически трудно запретить или регулировать. Могущественные страны исторически пытались регулировать или запрещать оружие, которое является “социально и военно разрушительным” из-за страха, что такое оружие может перевернуть существующую глобальную или внутреннюю динамику власти. Кампании, проводимые группами гражданского общества, имеющие неодобрение со стороны общественности, могут усилить дурную славу, делая оружие потенциально более уязвимым для контроля над вооружениями.

Модель Крутоф совпадает с моделью Уоттса, но ее основное внимание уделяется запретам на оружие, а не контролю над вооружениями в целом. Она выделяет восемь факторов, которые влияют на успех запрета на оружие. Оружие, которое причиняет чрезмерные травмы или ненужные страдания или которое по своей сути неизбирательно, скорее всего, будет запрещено. Страны, как правило, сопротивляются регулированию или запрету оружия, которое продемонстрировало военную или стратегическую полезность. Оружие, которое является уникальным или предоставляет стране “единственное средство достижения определенных целей”, трудно регулировать или запрещать. Более вероятно, что запрет, который является узким и четко определяет, что разрешено, а что нет, будет эффективным. Существующий договор или положение об определенном оружии могут сделать будущий контроль над вооружениями более успешным, если только технологические разработки не увеличат военную полезность оружия. Правозащитные группы и общественное мнение могут повлиять на рассмотрение странами вопроса о запрете на оружие, хотя, как отмечает Крутоф, “этот фактор далек от решающего”. Наконец, на успех запрета на оружие влияет как общее число стран, желающих поддержать запрет, так и то, какие страны согласны подписать его.

Уоттс и Крутоф согласны с тем, что эффективность оружия, возможно, является наиболее важным фактором, влияющим на успех контроля над вооружениями. Хотя их интерпретации немного различаются, оба утверждают, что оружие с уникальными ценными возможностями трудно регулировать. Уоттс фокусируется на социальной или военной разрушительности оружия — способности оружия нарушать существующий баланс сил. Хотя могущественные страны могут стремиться сдерживать разрушительное оружие, он утверждает, что эти усилия редко увенчаются успехом. Крутоф утверждает, что оружие, уникальное по своей “способности наносить разрушения определенного типа” или достигать определенных военных целей, вероятно, будет устойчиво к контролю над вооружением.

Желательность и осуществимость контроля над вооружениями

Успех или неудача контроля над вооружениями зависит как от его желательности, так и от его осуществимости. Желательность контроля над вооружениями включает в себя расчет государствами предполагаемой военной ценности оружия в сравнении с его предполагаемой повышенной опасностью (потому что оно бесчеловечно, неизбирательно или разрушительно для социального или политического порядка). Таким образом, желательность контроля над вооружениями зависит от желания государств сохранить оружие для своих собственных целей, уравновешенного их желанием ограничить его использование противниками.

Осуществимость контроля над вооружениями включает в себя способность государств добиваться ясности в отношении желаемой степени сдерживания, способность государств соблюдать соглашения об ограничении применения, способность государств проверять соблюдение при определенном количестве государств, необходимом для обеспечения сотрудничества. Контроль над вооружениями имеет наилучшие шансы на успех, когда высока как желательность, так и осуществимость.

Контроль над вооружениями считается успешным, когда поведение государства ограничено в разработке оружия, его количестве, размещении или использовании. Соглашения о контроле над вооружениями, которые не могут сдерживать поведение государства, не считаются успешными. В редких случаях сдерживание происходит по молчаливому согласию, без какого-либо официального договора или другого механизма. Однако, как правило, официальные соглашения являются полезным механизмом координации между государствами для достижения ясности в отношении того, что разрешено, а что нет. Во многих случаях успех существует в широком спектре. Немногие соглашения о контроле над вооружениями выполняются на 100% с нулевыми нарушениями. Некоторые из наиболее успешных соглашений, такие как современные запреты на химическое и биологическое оружие или ограничения на распространение ядерного оружия, имеют исключения и нарушителей. Другие соглашения успешны только в течение определенного периода времени, после чего технология или политическая обстановка меняются таким образом, что они рушатся. Тем не менее, даже частично успешные соглашения могут быть ценными для уменьшения ущерба за счет улучшения стабильности, уменьшения жертв среди гражданского населения или уменьшения страданий комбатантов.

Последствия для искусственного интеллекта

Технология ИИ создает проблемы для контроля над вооружениями по целому ряду причин. Многие из ее применений имеют двойное назначение. Будучи новой технологией, ее полный потенциал еще предстоит реализовать, что может помешать усилиям по ее контролю. Проверка любого соглашения о контроле над вооружениями с поддержкой ИИ будет сложной задачей. Государствам, вероятно, потребуется разработать методы обеспечения соблюдения требований другими государствами, чтобы им было удобно ограничивать свои собственные возможности. Эти препятствия, хотя и значительные, не являются непреодолимыми во всех случаях. При определенных условиях контроль над вооружениями может быть осуществим для некоторых военных приложений ИИ. Даже когда государства конкурируют в области военного ИИ, они должны искать возможности для снижения связанных с ним рисков, в том числе с помощью мер по контролю над вооружениями, где это возможно.

ИИ как технология общего назначения

Искусственный интеллект - это технология общего назначения, подобная электричеству или двигателю внутреннего сгорания, а не отдельное оружие, такое как подводная лодка, расширяющаяся пуля или ослепляющий лазер. Этот аспект технологии создает несколько проблем с точки зрения контроля над вооружениями.

Во-первых, технология ИИ применяется как в гражданской, так и в военной сфере, и поэтому широко доступна. Двойственный характер технологии делает контроль над вооружениями сложным в двух отношениях. С одной стороны, снижается вероятность успеха режима нераспространения оружия с применением ИИ. С другой стороны, широкая доступность технологий ИИ означает, что для соблюдения режима контроля над вооружениями потребуется много участников, чтобы он был эффективным. При прочих равных условиях координация, вероятно, будет более сложной и с большим числом участников.

Во-вторых, универсальный характер технологии ИИ может затруднить установление четких координационных центров для контроля над вооружениями. Это особенно верно, учитывая, что само его определение является нечетким и открытым для многих интерпретаций. На практике ИИ представляет собой настолько широкую область практики, что объявление “без применения ИИ” было бы аналогично высказыванию о государстве “без индустриализации” в конце XIX века. Хотя государства пытались регулировать или запрещать многие конкретные технологии, появившиеся в результате промышленной революции (включая подводные лодки, самолеты, воздушные шары, отравляющие газы и взрывающиеся или расширяющиеся пули), обещание государств просто не использовать какие-либо технологии индустриальной эпохи в военных действиях было бы несостоятельным.

Что касается технологий ИИ, то сегодня многие военные приложения, вероятно, будут использоваться не для использования оружия, что улучшает бизнес-процессы или оперативную эффективность, такие как прогнозное обслуживание, обработка изображений или другие формы прогнозной аналитики или обработки данных (которые могут помочь оптимизировать военные операции). Эти приложения ИИ могут повысить эффективность на поле боя за счет повышения уровня оперативной готовности, ускорения сроков развертывания, сокращения циклов принятия решений, улучшения ситуационной осведомленности или предоставления многих других достижений. Однако вопрос о том, где следует провести границу между приемлемым и неприемлемым использованием ИИ в военных целях, в большинстве случаев не может ясным. Государствам потребуется точное понимание, чтобы любое соглашение было эффективным.

Опыт государств в области контроля над вооружениями в отношении технологий, появившихся во время промышленной революции, является полезным историческим руководством, поскольку государства пытались регулировать (и в некоторых случаях преуспели) конкретные области применения промышленных технологий общего назначения, включая двигатели внутреннего сгорания (подводные лодки и самолеты. Эти усилия не всегда были успешными, но не потому, что государства не могли определить, что такое подводная лодка или самолет, и даже не потому, что государства не могли ограничить их гражданское использование (что не было необходимо для успеха запретов). Скорее, причины неудачи были связаны с конкретной формой использования этого оружия в военных действиях.

Анализ показывает, что, хотя запрет всех военных приложений ИИ может быть непрактичным по многим причинам, существует достаточно исторических свидетельств того, что государства могут согласиться ограничить конкретные военные применения ИИ. Тогда вопрос заключается в том, какие конкретные военные приложения ИИ могут соответствовать необходимым критериям желательности и осуществимости контроля над вооружениями. Поскольку ИИ может использоваться для многих приложений, могут быть определенные конкретные применения, которые считаются особенно опасными, дестабилизирующими или иным образом вредными. Приложения ИИ, связанные с ядерной стабильностью, автономным оружием и кибербезопасностью, уже были в центре внимания ученых. Однако могут быть другие важные приложения ИИ, которые заслуживают дополнительного рассмотрения. Даже в конкретных областях желательность и осуществимость контроля над вооружениями могут во многом зависеть от способа применения технологии. Запреты или правила могут быть разработаны исключительно в отношении конкретных технологий ИИ, которые считаются особенно проблематичными, в частности, ограничению производства пуль, которые предназначены для взрыва внутри тела, а не всех взрывающихся снарядов.

ИИ как новая технология

Одна из трудностей в прогнозировании того, какие конкретные приложения ИИ могут заслуживать дальнейшего рассмотрения для контроля над вооружениями, заключается в том, что пока не ясно, как именно ИИ будет использоваться в войне. Эта проблема не нова. В конце XIX и начале XX веков государства боролись за то, чтобы успешно контролировать новые технологии индустриальной эпохи именно потому, что они постоянно развивались.

Существуют способы, с помощью которых контроль над вооружениями становится как проще, так и сложнее для новых технологий. С одной стороны, превентивные запреты на новые технологии могут быть в некоторых отношениях проще, потому что у государства нет необходимости отказываются от оружия, которое уже интегрировано в их вооруженные силы, от которого они зависят в плане безопасности. С другой стороны, регулирование новых технологий иногда может быть более сложным.

Точно так же степень опасности оружия может быть неизвестна до тех пор, пока оно не будет применено, как это было в случае с ядовитым газом и ядерным оружием. Государства могут оказывать сильное сопротивление ограничению разработки оружия, которое представляется особенно ценным.

Восприятие военными ИИ как технологии, “меняющей правила игры”, может стать препятствием для достижения государственной сдержанности. Военные по всему миру инвестируют в ИИ и, возможно, неохотно запрещают некоторые виды его применения. Кроме того, восприятие систем ИИ как обладающих сверхчеловеческими возможностями, точностью, надежностью или эффективностью может снизить восприятие того, что некоторые приложения ИИ могут быть дестабилизирующими или опасными.

Представления о технологии ИИ, даже если они необоснованны, могут оказать существенное влияние на готовность государств рассматривать контроль над вооружениями для военных приложений ИИ. Со временем эти представления, вероятно, будут в большей степени соответствовать реальности, поскольку государства внедряют и используют военные системы ИИ. Однако в некоторых случаях, даже если некоторые приложения ИИ в конечном итоге будут признаны достойными контроля над вооружениями, может быть трудно загнать джинна обратно в бутылку, если они уже интегрированы в вооруженные силы государств или используются на поле боя.

Проблемы с проверкой соответствия

Даже если государства могут договориться о четких координаторах контроля над вооружениями, а компромисс между затратами и выгодами поддерживает взаимную сдержанность, проверка соблюдения любого режима контроля над вооружениями имеет решающее значение для его успеха. Одна из сложностей с технологией ИИ заключается в том, что, как и в случае с другими формами программного обеспечения, когнитивные атрибуты, которыми обладает система ИИ, нелегко наблюдать извне. “Умная” бомба, ракета или автомобиль могут выглядеть так же, как и “тупая” система того же типа. Датчики, которые автономное транспортное средство использует для восприятия окружающей среды, особенно если оно использует автономную навигацию, могут быть видны, но конкретный используемый алгоритм может и не быть. Это проблема при рассмотрении контроля над вооружениями для военных систем с поддержкой ИИ. Государства могут оказаться не в состоянии поддерживать взаимную сдержанность, если они не могут проверить, что другие соблюдают соглашение.

Существует несколько потенциальных подходов, которые можно было бы рассмотреть в ответ на эту проблему: государства могли бы проводить интрузивные инспекции, ограничивать физические характеристики систем с поддержкой ИИ, регулировать наблюдаемое поведение систем ИИ и ограничивать вычислительную инфраструктуру.

Внедрение навязчивых инспекций. Государства могли бы согласиться на режимы интрузивных инспекций, которые разрешают сторонним наблюдателям доступ к объектам и конкретным военным системам для проверки соответствия их программного обеспечения режиму контроля над вооружениями ИИ. Инспекционные режимы ИИ будут страдать от той же проблемы прозрачности, которая возникает для других видов оружия: инспекции могут выявить уязвимости в системе вооружений для конкурирующей страны. Однако будущий прогресс в проверке программного обеспечения, обеспечивающего конфиденциальность, может помочь государствам преодолеть эту проблему, проверяя поведение части программного обеспечения, не раскрывая личную информацию. Или государства могут просто согласиться с тем, что выгоды от проверки перевешивают риски повышения прозрачности.

Одна из проблем с инспекциями заключается в том, что если разница между разрешенными и запрещенными возможностями заключается в программном обеспечении, государство может просто обновить свое программное обеспечение после ухода инспекторов. Обновление программного обеспечения можно было бы производить относительно быстро и масштабно, гораздо проще, чем строить больше ракет или установок по обогащению урана. В принципе, государства могли бы преодолеть эту проблему путем разработки в будущем более совершенных технических подходов, таких как непрерывный мониторинг программного обеспечения для обнаружения изменений или путем встраивания функциональности в аппаратное обеспечение. Если государства не смогут уверенно преодолеть проблему быстрого и масштабируемого обновления систем ИИ после инспекций, режимы интрузивных инспекций останутся слабым решением для проверки соблюдения, даже если государства были готовы согласиться на такие инспекции.

Ограничение внешних наблюдаемых физических характеристик систем с поддержкой ИИ. Государства могли бы сосредоточиться не на когнитивных способностях системы, а на общих физических характеристиках, которые легко наблюдать и которые трудно изменить, таких как размер, вес, мощность, выносливость, полезная нагрузка, боеголовка и так далее. При таком подходе государства могли использовать любые когнитивные характеристики (датчики, аппаратное и программное обеспечение), которые они хотели для системы. Ограничения на контроль над вооружениями будут распространяться только на общие физические характеристики транспортного средства или боеприпаса, даже если фактическое беспокойство было вызвано военными возможностями, обеспечиваемыми ИИ. Например, если бы государства были обеспокоены скоплениями небольших противопехотных беспилотников, вместо того, чтобы разрешать только “тупые” маленькие беспилотники (что трудно проверить), государства могли бы просто запретить все небольшие беспилотники, оснащенные оружием, независимо от их когнитивных способностей. Государства ранее использовали аналогичные подходы, регулируя общие физические характеристики систем (которые можно было наблюдать), а не их полезную нагрузку (что действительно беспокоило государства, но было сложнее проверить). Многочисленные договоры времен холодной войны ограничивали или запрещали определенные классы баллистических и крылатых ракет, а не просто запрещали их вооружение ядерным оружием. Альтернативный подход, ограничивающий только ракеты с ядерным вооружением, позволил бы использовать некоторые обычные ракеты, но его было бы труднее проверить.

Регулирование наблюдаемого поведения систем с поддержкой ИИ. Государства могли бы сосредоточить правила на наблюдаемом поведении системы ИИ, например, на том, как она работает в определенных условиях. Это было бы аналогично концепции ограничений на бомбардировки “без городов”, которая запрещала не бомбардировщики, а способ их применения. Этот подход был бы наиболее эффективным при работе с физическими проявлениями систем ИИ, в которых внешнее поведение системы наблюдается другими государствами. Например, государства могут устанавливать правила поведения автономных надводных кораблей ВМС вблизи других кораблей.

Государства могут даже принять правила того, как вооруженные автономные системы могут четко сигнализировать об эскалации силы, чтобы избежать непреднамеренной эскалации в мирное время или в кризисных ситуациях. Конкретный алгоритм, который государство использовало для программирования поведения, не имеет значения; разные государства могут использовать разные подходы. Регулироваться будет поведение системы ИИ, а не ее внутренняя логика. Однако для некоторых военных приложений ИИ, которые не поддаются наблюдению, этот подход не будет эффективным. (Например, ограничения на роль ИИ в ядерном командовании и контроле, вероятно, не будут заметны противникам.) Другим ограничением этого подхода является то, что, как и в случае с интрузивными проверками, поведение системы потенциально может быть быстро изменено с помощью обновления программного обеспечения, что может исключить проверяемость и подорвать доверие.

Ограничение вычислительной инфраструктуры. Системы ИИ имеют физическую инфраструктуру, используемую для вычислений — чипы, и одним из подходов может быть сосредоточение внимания на элементах аппаратного обеспечения ИИ, которые можно наблюдать или контролировать. Потенциально это можно было бы сделать путем ограничения специализированных чипов ИИ, если бы эти специализированные чипы можно было контролировать с помощью режима нераспространения (и если бы эти чипы были необходимы для запрещенного военного потенциала). Другой подход, по-видимому, мог бы быть направлен на ограничение крупномасштабных вычислений, если бы вычислительные ресурсы были наблюдаемыми или могли отслеживаться. В последние годы ведущие исследовательские лаборатории ИИ вложили значительные средства в крупномасштабные вычисления для машинного обучения, хотя неясно, перевешивает ли ценность этого исследования его значительные затраты и как долго эта тенденция может продолжаться. Существуют также противоположные тенденции в эффективности вычислений, которые со временем могут демократизировать возможности ИИ за счет снижения вычислительных затрат на обучение систем машинного обучения.

Одним из важных факторов, позволяющих осуществлять контроль над вооружениями, ориентированный на аппаратное обеспечение ИИ, является степень демократизации инфраструктуры производства чипов во всем мире по сравнению с их концентрацией в руках нескольких участников. Современные цепочки поставок полупроводников сильно глобализированы, но имеют ключевые точки ограничения. Эти узкие места открывают возможности для контроля доступа к оборудованию ИИ. Например, в 2020 году Соединенные Штаты успешно отрезали китайскую телекоммуникационную компанию Huawei от передовых чипов, необходимых для беспроводной связи 5G, ограничив использование оборудования американского производства для производства чипов (хотя сами чипы были изготовлены на Тайване). Аналогичные меры, вероятно, можно было бы использовать в будущем для контроля доступа к оборудованию ИИ, если бы производство этих чипов было аналогичным образом ограничено несколькими ключевыми участниками.

Будущее развитие цепочек поставок полупроводников весьма неопределенно. Потрясения в цепочке поставок и геополитическая конкуренция ускорили вмешательство государства в мировой рынок полупроводников, вызвав значительную неопределенность в развитии рынка. Существуют тенденции, указывающие на большую концентрацию цепочек поставок оборудования и другие тенденции к большей демократизации. Высокая стоимость заводов по производству полупроводников, или фабрик, является одним из факторов, ведущих к большей концентрации в отрасли. С другой стороны, геополитические факторы заставляют Китай и Соединенные Штаты наращивать собственные мощности. Существуют мощные рыночные и нерыночные силы, влияющие на мировую полупроводниковую промышленность, и долгосрочные последствия этих сил для цепочек поставок неясны.

Дальнейший путь

Ближайшая историческая аналогия с текущим моментом с искусственным интеллектом - это милитаризация технологий индустриальной эпохи на рубеже ХХ века и попытки государств в то время контролировать это опасное новое оружие. После принятия Санкт-Петербургской декларации в 1868 году государства развернули бурную деятельность по контролю над вооружениями как в преддверии Первой мировой войны, так и в межвоенный период перед Второй мировой войной. Ведущие военные державы чуть ли не ежегодно встречались, чтобы обсудить контроль над вооружениями. Не все усилия привели к соглашениям, и не все договоры, которые были ратифицированы, были заключены в военное время, но масштаб дипломатической деятельности показывает усилия и терпение, необходимые для достижения даже скромных результатов в области контроля над вооружениями.

Есть несколько шагов, которые политики, ученые и члены гражданского общества могут предпринять сегодня, чтобы изучить потенциал контроля над вооружениями с применением ИИ. Они включают встречи и диалог на всех уровнях для лучшего понимания технологии, того, как она может быть использована в военных действиях, и потенциальных мер по контролю над вооружениями. Научные конференции, межакадемические обмены, двусторонние и многосторонние диалоги и дискуссии на различных международных форумах - все это ценно для содействия диалогу и взаимопониманию между различными станами. Анализ потенциальных мер по контролю над вооружениями должен быть тесно связан с самой технологией и поведением, которое она позволяет, и в этих диалогах должны участвовать ученые и инженеры по ИИ, чтобы гарантировать, что политические дискуссии основаны на технических реалиях. Кроме того, поскольку технология ИИ остается изменчивой и быстро развивается, те, кто рассматривает контроль над вооружениями, должны быть готовы к адаптации и переключению внимания на различные аспекты технологии ИИ или военные возможности, которые она обеспечивает по мере развития. Показатели для отслеживания прогресса и распространения ИИ также помогут осветить как возможности для контроля над вооружениями, так и будущие вызовы.

Политики могут предпринять шаги сегодня, которые могут сделать технологию более контролируемой в долгосрочной перспективе, определяя ее развитие, особенно в аппаратном обеспечении. Введение экспортного контроля в ключевых узких точках глобальной цепочки поставок может помочь контролировать распространение базовых технологий, которые позволяют использовать ИИ, концентрируя цепочки поставок и повышая управляемость в будущем. Однако экспортный контроль может привести к ускорению аборигенизации технологий, поскольку субъекты, которые отрезаны от жизненно важных технологий, удваивают свои усилия по наращиванию своего национального потенциала.

На заре революции ИИ неясно, как военные будут внедрять ИИ, как это повлияет на ведение войны и какие формы контроля над вооружениями государства могут счесть желательными и осуществимыми. Однако политики могут предпринять шаги сегодня, чтобы заложить основу для потенциальных мер по контролю над вооружениями в будущем, включая не только формирование эволюции технологии, но и политического климата. История контроля над вооружениями показывает, что меры по контролю над вооружениями часто основаны на предыдущих успешных соглашениях о контроле над вооружениями. Небольшие шаги сейчас могут привести к большим успехам в будущем, и государствам следует искать возможности для взаимной сдержанности, чтобы сделать войну менее ужасной, насколько это возможно.

***

Явно доклад писали люди, которых можно назвать «вашингтонскими мечтателями». Их рекомендации красивы, гуманны, но абсолютно неисполнимы в современных условиях, которые многими международными экспертами названы самыми опасными для человечества со времен Карибского кризиса.

Например, научный сотрудник Школы политологии и теории управления имени Шара - Закари Келленборн в статье в журнале Bulletin of the Atomic Scientists в начале 2022 г. предупредил, что предоставление искусственному интеллекту контроля над ядерным оружием может спровоцировать апокалиптический конфликт. Ведь ИИ играет все более важную роль в управлении разрушительным оружием, включая американский ядерный бомбардировщик B-21, китайские гиперзвуковые ракеты с искусственным интеллектом и российский ядерный беспилотник «Посейдон».

«Если бы искусственный интеллект контролировал ядерное оружие, все мы могли бы погибнуть. Военные всё чаще включают автономные функции в системы вооружения. Нет гарантии, что некоторые военные не поставят ИИ во главе ядерных пусков», — написал Келленборн.

По словам эксперта, в контексте ядерного оружия у правительства может быть мало данных о военных платформах противника. Существующие данные могут быть структурно предвзятыми, например, из-за того, что они полагаются на спутниковые снимки. Данные могут не учитывать очевидные, ожидаемые изменения, такие как изображения, сделанные в туманную, дождливую или пасмурную погоду.

Обучение программ ядерного оружия на базе ИИ также представляет собой серьезную проблему, поскольку ядерное оружие использовалось только дважды и реальных данных недостаточно.

Здесь трудно спорить.